為什麼 Rust 會成為 AI 的未來語言

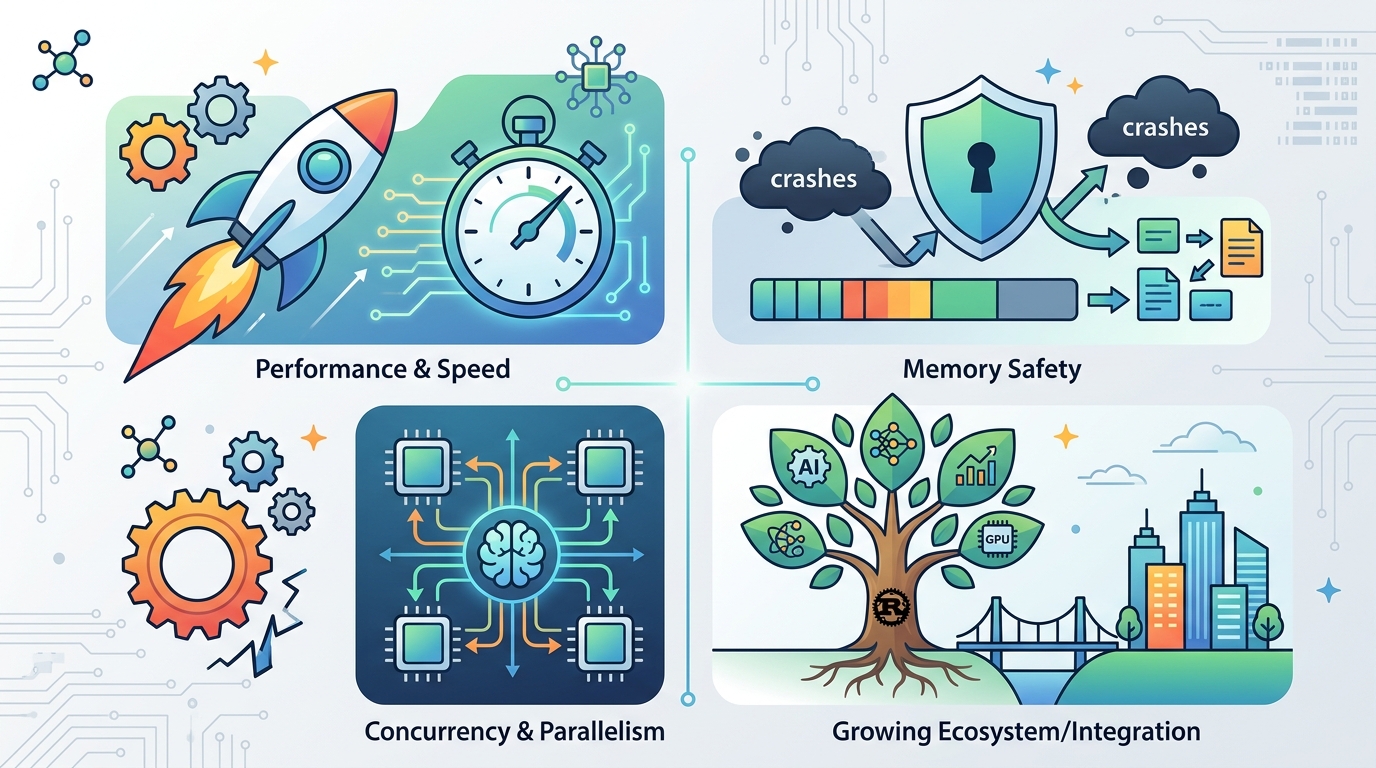

Rust 會成為更多 AI 基礎設施的主力,因為它把安全、並發與效能前移到編譯期解決。

Rust 會成為更多 AI 基礎設施的主力,因為它把安全、並發與效能前移到編譯期解決。

我認為 Rust 正在成為 AI 基礎設施的預設語言,因為它把正確性、並發和效能,從事後補救變成編譯期保證。

這個判斷不是抽象偏好,而是由生產環境的現實推動。Hugging Face 的 Rust 版 tokenizers 相較純 Python 版本常見 10 倍到 100 倍的速度提升,Polars 也一再在資料處理基準中壓過 pandas。這些勝利說明,現代 AI 的瓶頸往往不在模型本身,而在周邊基礎設施:解析、串流、檢索、排程、記憶體管理與失敗處理。

第一個論點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

AI 真正在生產環境裡出問題的地方,通常不是模型,而是那些「看起來很無聊」的層。當系統要搬運 embedding、協調 worker、或在高併發下回應請求時,記憶體壓力與競態條件比模型架構更致命。Rust 直接處理這些問題,並且把很多原本要靠 runtime 才能發現的錯誤,提前攔在編譯期。

這不是理論上的優勢。像 Ruff、uv 這類 Rust 工具之所以快速普及,就是因為它們把開發者工具做得快到可以「消失」在背景裡。AI 基礎設施也是同一套邏輯:tokenization、vector search、session orchestration 只要快一個數量級,整個系統的成本和擴展難度就會一起下降。Python 可以負責原型,但 Rust 更適合負責把原型活著送進生產。

第二個論點

Rust 的編譯器不只是護欄,而是產品本身。它把複雜度前移到 compile time,這正是 AI 基礎設施最需要的地方。ownership、borrowing 和嚴格型別檢查,會在程式跑之前就逼出不安全的共享、錯誤的生命週期假設,以及常見的並發漏洞。結果是更少線上事故、更少隱藏邊界條件,也更少依賴人工 code review 去抓那些動態語言很容易漏掉的錯誤。

這件事在 AI 開始大量寫程式後更重要。Copilot、Claude Code、Cursor 可以產出看起來合理的 Python、JavaScript,甚至 C 程式,但「看起來合理」不等於正確。一次並發服務的生成結果,可能測試都過了,卻在壓力下崩潰。Rust 的編譯器像自動審查員,會在部署前擋下 unsafe sharing、無效 lifetime 與錯誤假設。Microsoft 曾估計 70% 的安全漏洞來自記憶體安全問題,這讓結論更直接:如果 AI 會生成更多基礎設施,語言就必須能在入口處攔住不安全程式碼。

反方可能怎麼說

最強的反對意見是:AI 仍然是研究優先的領域,而 Python 壟斷了研究工作流。這點沒錯。PyTorch、TensorFlow、scikit-learn、Hugging Face 建起來的生態,Rust 不可能取代它們在實驗、訓練與快速迭代上的地位。Python 的問題不是不好,而是對於今天最重要的生產環節,它太寬鬆了。

另一個反對點也成立:Rust 的學習曲線高,borrow checker 會拖慢 onboarding,有些團隊會把太多時間花在跟編譯器搏鬥,而不是交付產品。這個批評對短命原型尤其正確。若系統只是一次性試驗,Python 更快;若系統要長期承擔關鍵 AI 工作負載,編譯器的嚴格反而是在替你省掉事故成本。

所以,Python 對 Rust 的辯論其實問錯了問題。真正的分界不是語言信仰,而是系統生命週期。當 AI 工作流從 notebook 走向 service,語言選擇就不再是便利性,而是營運風險。Rust 之所以會贏,不是因為它更潮,而是因為它把執行期的不確定性,前移成編譯期可以處理的確定性。

你能做什麼

如果你是工程師,別把 Rust 當成副修,先把它用在 AI 堆疊裡最吃效能、最需要並發、最怕出事的地方:搜尋、tokenization、排程器、串流管線、agent 基礎設施。如果你是 PM 或創辦人,保留 Python 來做探索,但一旦可靠性與成本變成產品約束,就把系統核心搬到 Rust。真正有效的組合不是 Rust 全包,而是 Rust 負責失敗代價高的部分,Python 負責仍在探索中的部分。