開源 AI 專案清單怎麼挑

這份 GitHub 清單收錄可直接上線的開源 AI 專案,從 PyTorch 到 vLLM 都有,2,486 顆星,適合想找模型、推理、RAG 和代理工具的工程師。

awesome-opensource-ai 這個 GitHub repo,很像一份開源 AI 採購單。它有 2,486 顆星、219 次 fork,還是 Python 專案。重點不是收很多連結,而是挑能上線的工具。

說白了,現在 AI 工具太多了。真正難的不是找得到,而是選得對。這份清單把模型、推理、RAG、代理、評測、訓練、MLOps 分開整理,對台灣工程師很實用。

這份清單到底在挑什麼

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

README 寫得很直白。只有「battle-tested」和「production-proven」的專案會進榜。這句話聽起來很像行銷,但看分類就知道它不是亂吹。

它把 AI 系統拆成幾塊。像是核心框架、基礎模型、推理引擎、代理系統、檢索、媒體生成、訓練、MLOps、benchmark 和安全工具。這種切法很務實。

很多目錄站只是連結堆疊。這份清單比較像給工程團隊看的地圖。你要做產品、部署服務、還要顧成本,它都幫你先分好類。

- GitHub 目前有 2,486 顆星

- 有 219 次 fork

- 主專案是 Python

- 內容分成 14 個區塊

第一個區塊就能看到熟面孔。像是 PyTorch、TensorFlow、JAX 和 Flax。但它也放了 tinygrad 這種小而怪的專案。

我覺得這種搭配很有意思。大框架負責生產力,小專案負責理解底層。兩種都需要,少一個都會踩雷。

它反映的是整個 AI stack

開源 AI 早就不是單一類別了。現在它是一整層 stack。這份 repo 把訓練、推理、檢索、代理和上線工具拆開,才方便比較。

像推理區塊會看到 vLLM 和 Text Generation Inference。這兩個名字,很多團隊都拿來比延遲、吞吐量和記憶體用量。

代理區塊則有 LangGraph、AutoGen、CrewAI。這些工具都在解同一題:怎麼把多次 LLM 呼叫串起來,還不把流程寫成一團亂。

“The future of AI is not about one model. It’s about systems.” — Andrew Ng

這句話很適合拿來看這份清單。因為它關心的不是單一模型多強,而是整個系統怎麼組。

講白了就是,模型只是零件。真正決定產品能不能活下來的,是外面那一圈工具。

數字會告訴你誰比較成熟

這份清單厲害的地方,在於它不只列名字。很多條目還會放下載量、使用量或生態規模。這對選型很重要。

AI 世界很容易被 README 騙。頁面寫得漂亮,不代表能扛正式流量。數字至少能先幫你過濾一輪。

幾個例子很有代表性。Transformers 有超過 100 萬個模型,還有每天 25 萬次以上下載。PaddlePaddle 宣稱支援 2,300 萬以上開發者與 76 萬家企業。

- Transformers:模型生態最大宗之一

- sentence-transformers:做 embedding 很常見

- Polars:資料量一大就很有感

- Burn 和 Candle:Rust 派的代表

這些數字不是拿來炫耀而已。它們代表文件、社群、 bug 回報、範例數量,通常都比較完整。你真的要上線,這些都很重要。

而且這份清單也提醒一件事。Python 不是唯一答案。Rust、Julia、甚至更偏底層的實作,都在開源 AI 裡佔一席之地。

競品比一比,差很多

如果你只看名稱,會以為這些工具差不多。其實差很大。推理引擎、代理框架、資料處理工具,各自解的問題都不同。

拿推理來說,vLLM 主打高吞吐。TGI 則和 Hugging Face 生態綁得更緊。你如果已經大量用 Transformers,TGI 會比較順手。

代理框架也一樣。LangGraph 偏流程編排。AutoGen 偏多代理對話。CrewAI 則主打角色分工。你要的是哪一種工作流,答案會完全不同。

- vLLM:適合看吞吐與延遲

- TGI:適合 Hugging Face 使用者

- LangGraph:適合複雜流程

- AutoGen:適合多代理互動

- CrewAI:適合任務分工型設計

資料處理也有差。Polars 在大資料集上常比傳統 pandas 更俐落。這不是情懷問題,是效能問題。

我會建議團隊先問三件事。你的瓶頸是訓練、推理,還是資料管線。你要的是單機工具,還是要扛伺服器流量。你能接受多少維護成本。

這類清單為什麼現在更重要

以前大家找 AI 工具,常常先看 demo。現在不行了。很多團隊已經進到實作階段,開始在意延遲、成本、可觀測性和部署方式。

這也是為什麼 curated list 很有價值。有人先幫你把噪音過濾掉,你就不用每個 repo 都 clone 一次。這對時間很省。

放到台灣的情境也很現實。很多新創和企業都在做內部知識庫、客服助理、文件摘要、資料搜尋。這些場景最怕選錯工具,然後後面整套重寫。

開源 AI 的生態也越來越像分工市場。模型、推理、檢索、評測、監控,各有專門工具。你很少再看到一個 repo 想包山包海,還能每個都做好。

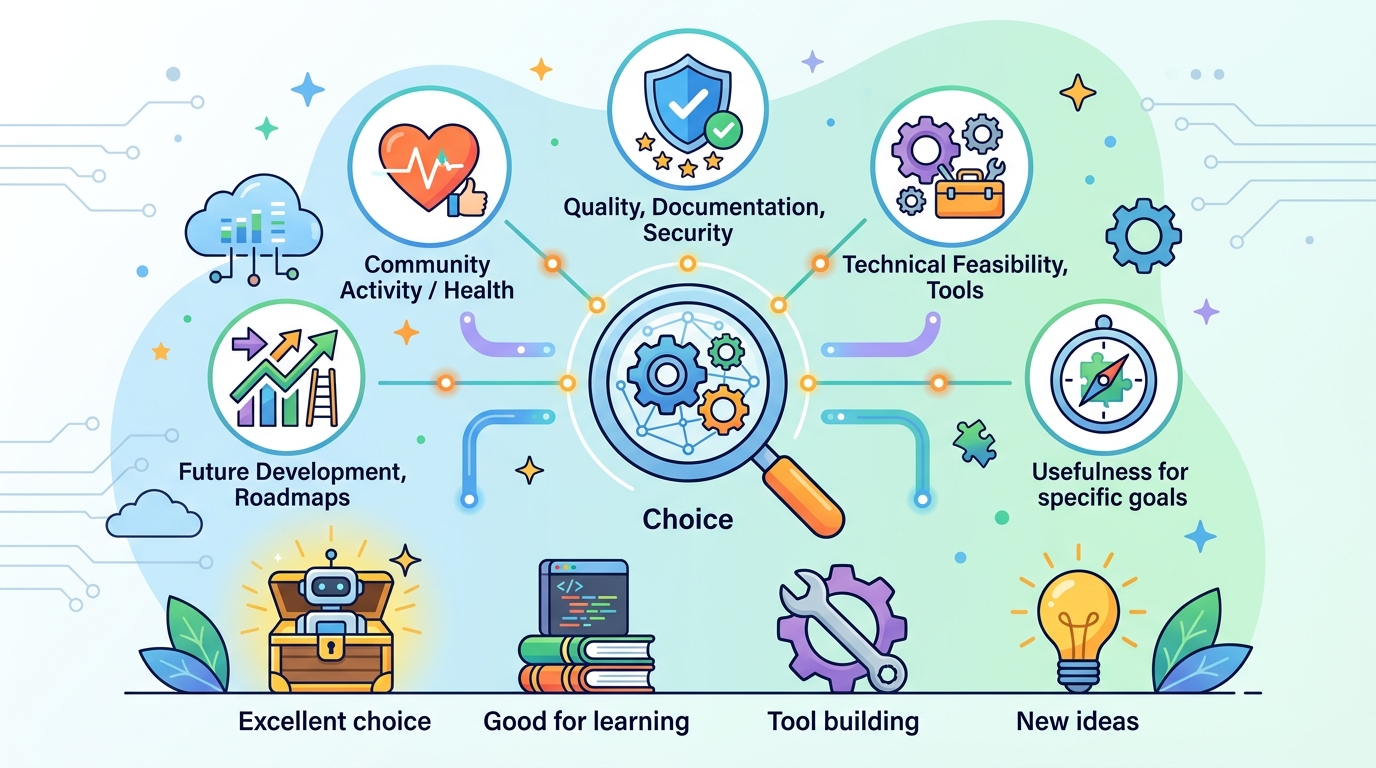

所以這份清單不是拿來收藏而已。它更像一份選型起點。你可以先看分類,再去比 benchmark、文件、社群活躍度和 issue 處理速度。

我會怎麼用這份清單

如果你是工程師,我會先從三個區塊下手。第一個看模型與訓練。第二個看推理。第三個看資料和 RAG。

如果你是產品或創業團隊,就先看能不能快速上線。能不能接 API。能不能把成本壓住。這些問題比「哪個最潮」重要太多。

我的預測很直接。接下來 12 個月,大家會更少問「哪個模型最強」。大家會更常問「哪個 stack 最穩」。如果你現在就要開始選,先從 awesome-opensource-ai 這種清單下手,會比亂搜 GitHub 省很多時間。

你也可以先挑一個場景。是要做 RAG,還是做模型服務。先把問題定義清楚,再去看工具,會準很多。