2026 免費 LLM API 推薦:30+平台比較

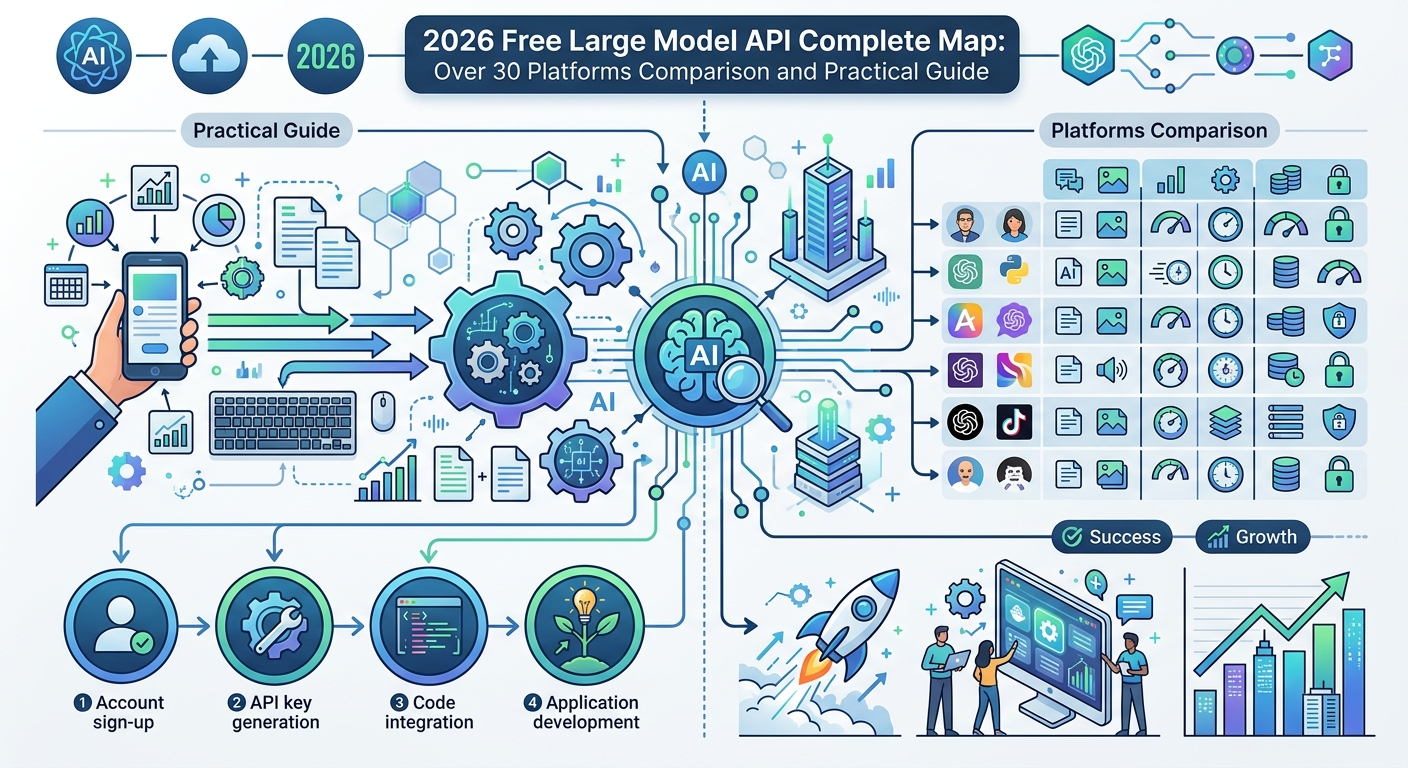

免費 LLM API 的競爭已進入激烈階段。從國內的智谱、月之暗面到國際的 Google AI Studio、GitHub Models,以及專注推理速度的 Groq,開發者現在有超過 30 個選擇。本文詳細比較各平台的額度、速率限制、模型陣容和適用場景,幫助你選出最適合當前專案的方案。

2026 年的大語言模型生態已經成熟到一個有趣的階段:免費額度變成了基本標配,而不是稀罕功能。無論你是學生、開發者還是創業團隊,都能找到至少一個支持你實驗想法的免費平台。但正因為選擇太多,如何挑選反而成了新問題。

國內平台:多模型競爭,差異化策略明顯

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

智谱 AI 的 GLM-4-Flash 永久免費政策打破了業界慣例。新使用者一次性獲得 2000 萬 Token,足以執行數千次高品質推理。更重要的是,它承諾「永久免費」——在國內大模型廠商中相當罕見。該服務支援 30 個並發請求,對於 POC(概念驗證)階段的應用已經夠用。

月之暗面 Kimi 走的是「超長上下文」路線。256K Token 的窗口對於處理長文檔、技術文件或完整程式碼庫有決定性優勢。雖然限流是每分鐘 3 次請求,但 Token 額度不限,適合需要一次性處理大量資訊的場景,比如程式碼審查或文檔總結。

硅基流动主打開源模型的多樣性。DeepSeek、Qwen 系列的 API 都能透過統一介面存取,速率限制為 1000 RPM per 模型,可以承載中等規模流量。如果你想測試各家開源模型而不想逐一註冊,硅基流动是捷徑。

字節豆包、阿里通義千問、百度文心、騰訊混元、訊飛星火等平台各有側重,但免費額度通常需要主動申請或參與活動才能獲得。這些廠商傾向於用免費層吸引長期使用者,而非無條件開放。

國際平台:生態成熟,額度最大

Google AI Studio 提供了可能是現階段最慷慨的免費配額。Gemini 2.5 Flash 每分鐘 30 個請求,每天 1440 個請求,額度高到足以支撐小型應用的日常運作。Google 的算力基礎設施意味著穩定性有保障,而 Gemini 的多模態能力(圖文音頻)在同級免費服務中獨樹一幟。

GitHub Models 的創新之處在於門檻最低——只需 GitHub 帳戶即可使用。GPT-4o、4-turbo 等高級模型都開放試用,限額是每分鐘 15 個、每天 150 個請求。對於 GitHub 使用者來說,這可能是最快上手的選擇。

Groq 代表了推理速度的極致。其 LPU(Language Processing Unit)硬體加速讓生成速度快 5-10 倍,免費版提供每天 1000 次請求。如果你的應用對延遲敏感(比如實時聊天應用),Groq 的性能優勢值得測試。

Cloudflare Workers AI 運用全球 CDN 基礎設施,每天 10000 Neurons 的免費額度可以透過邊緣計算節點就近執行推理。延遲低、成本低,特別適合全球分布式應用。OpenRouter 聚合了多家廠商的 API,國內可直連,無需代理,模型選擇最豐富。

第三方代理與風險考量

ChatAnywhere、GemAI、API520 等代理平台以「統一介面」和「規避地理限制」為賣點。雖然方便,但代理層增加了安全風險,而且免費政策往往不穩定。一旦廠商修改政策,代理服務可能突然失效。生產環境應該避免依賴這類服務。

實戰選擇指南

選擇哪個平台取決於三個維度:使用場景、預算容量和地理位置。學習和測試優先 Google AI Studio 或 GitHub Models,額度大且穩定。國內開發推薦 OpenRouter(可直連、模型多)或硅基流动(開源模型友好)。如果需要超長上下文,Kimi 的 256K 窗口無人能及。高速推理就選 Groq,多模態應用就用 Gemini。

重要提醒:速率限制要做好降級處理,準備備用方案。免費政策隨時可能變動,定期檢查官方文檔。最後,即使有免費額度,生產環境仍應採用付費 API 保證穩定性。多平台組合能有效分散風險。