HealthNLP_Retrievers 用級聯式 EHR 問答

這篇論文提出一個級聯式 LLM 管線,目標是在電子病歷上做有依據的臨床問答;但摘要沒有公開完整 benchmark 數字。

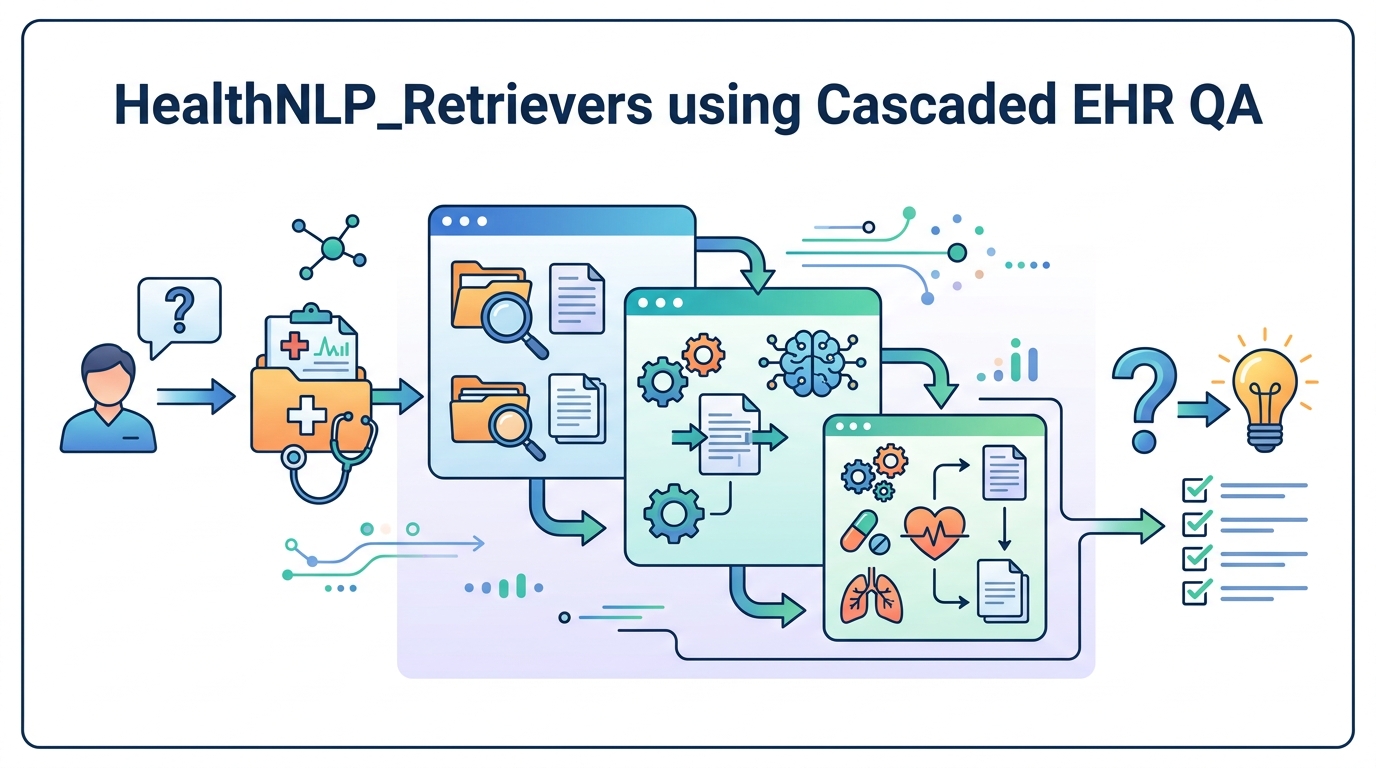

這篇論文提出一個級聯式 LLM 管線,用來在電子病歷上做有依據的臨床問答。

HealthNLP_Retrievers 的 HealthNLP_Retrievers at ArchEHR-QA 2026: Cascaded LLM Pipeline for Grounded Clinical Question Answering,在解一個很實際的痛點:怎麼讓大型語言模型回答 EHR(電子病歷)問題時,不要脫離原始病歷內容亂猜。

這件事對開發者很重要。臨床問答不是一般的搜尋或摘要。只要答案沒有緊扣來源,前面講得再順,最後都可能變成看起來合理、實際上不可靠的內容。尤其在醫療場景,可信度和可追溯性不是加分項,是基本門檻。

這篇在解什麼問題

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

從目前公開的摘要資訊來看,這篇論文的目標很明確:做 grounded clinical question answering,也就是讓回答能扎實地對應到病歷證據,而不是只靠模型自由發揮。

EHR 的資料型態本來就很麻煩。內容長、格式雜、上下文多,而且同一個病人的資訊常常散在不同筆記、不同時間點、不同欄位裡。臨床問題又通常很精準,像是某個檢查結果、某段病程、某次用藥或某個時間點的狀態。這種任務很容易讓 LLM 出現熟悉的失誤:語句流暢,但抓錯段落、漏掉關鍵細節,甚至把不該混在一起的資訊拼成一個答案。

所以這篇論文不是在追求「更會聊天」的模型,而是在處理「更能對答案負責」的系統設計。標題直接點出關鍵做法:cascaded pipeline,級聯式流程,而不是一次輸出到底。

級聯式管線怎麼運作

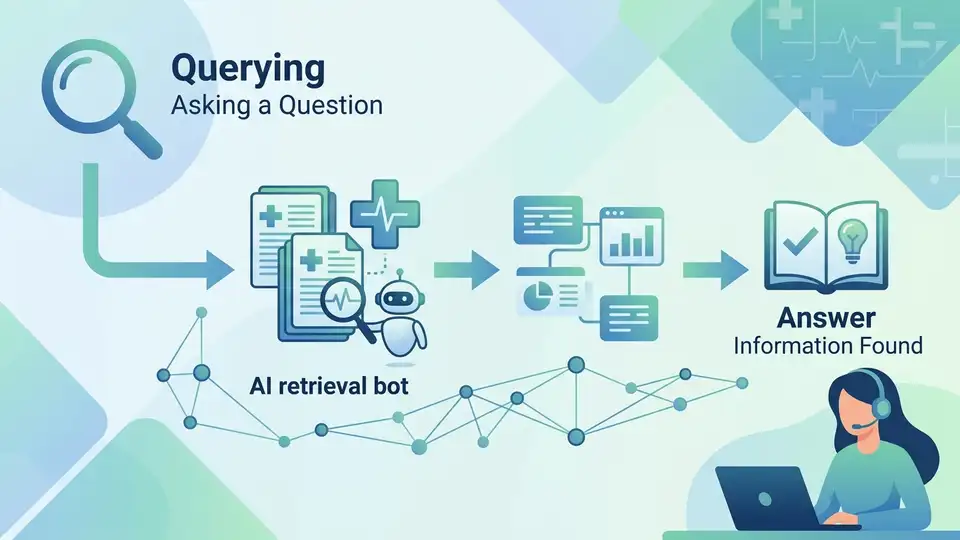

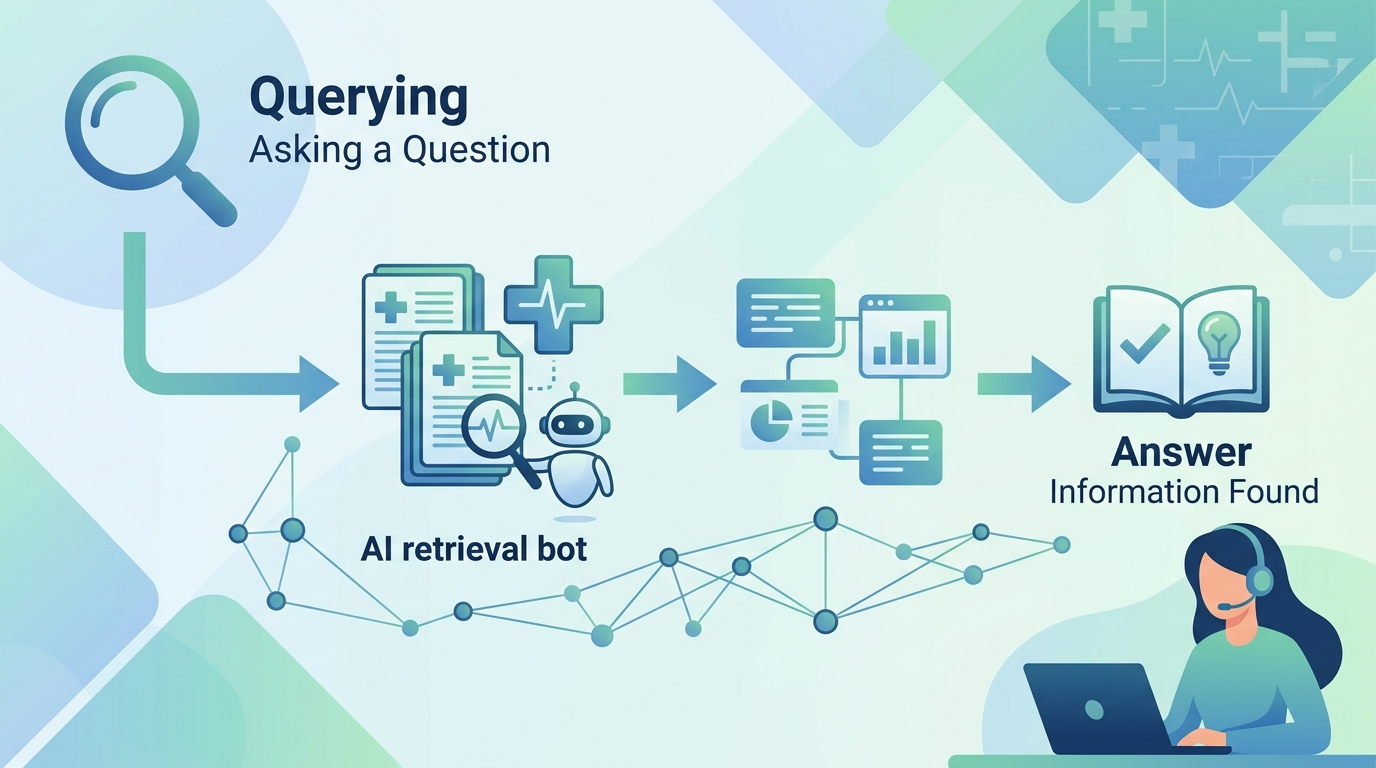

摘要頁面沒有把整個架構完整攤開,所以不能硬說它一定有哪些模組。不過「cascaded LLM pipeline」這個說法,本身就已經透露出設計方向:把任務拆成多個階段,先縮小範圍,再生成答案。

用白話講,這類流程通常會長得像這樣:先從 EHR 裡找出可能相關的證據,再把候選內容過濾、排序或重整,最後才交給 LLM 產生最終回答。這樣做的好處很直接。第一步負責找資料,第二步負責挑資料,第三步負責寫答案。每一步都比把整件事丟給單一模型更可控。

這種拆法對工程團隊很有吸引力,因為每個環節都能單獨調整。找不到資料,可以修 retrieval。抓太多無關內容,可以修 reranking 或 evidence selection。答案開始亂編,可以限制最終生成階段看到的上下文。換句話說,級聯式設計把「怎麼錯」拆得更細,也讓除錯更有方向。

在醫療這種需要留痕的場景,這點尤其重要。即使這份摘要沒有寫明它是否輸出引用或證據標記,級聯式流程至少在系統層級上,已經比單次 prompt 直接回答更接近「先找證據、再下結論」的工作方式。

論文實際證明了什麼

這裡要先講清楚一個限制:目前可見的摘要內容沒有公開完整 benchmark 數字,也沒有提供 dataset 細節、評估指標或分數。所以如果你想看「比誰高幾分」,這份 raw 資料並沒有給。

不過,從可見資訊還是能確認幾件事。第一,這篇工作是放在 ArchEHR-QA 2026 的情境下談的,代表它是在臨床問答的任務框架裡處理 EHR grounding 問題。第二,它明確把自己定位成一個 cascaded LLM pipeline,而不是單一模型或單一 prompt 解法。第三,作者想解的核心不是一般 QA,而是 grounded clinical QA。

也就是說,這篇論文真正展示的重點,比較像是「系統路線」而不是「公開數字」。它告訴你:如果要做 EHR 問答,作者認為多階段的 retrieval-and-generation 管線是值得採用的方向。至於效果到底多好、成本多高、哪一段最有效,摘要頁面沒有交代。

這也是目前能誠實下的結論。沒有數字,就不要補數字;沒有 ablation,就不要自己腦補哪個模組贏最多。就 raw 資料來看,這篇摘要沒有把實驗細節完整公開。

- 摘要沒有公開 benchmark 數字。

- 摘要沒有列出資料集名稱或評估指標。

- 摘要只明確透露「cascaded LLM pipeline」與「grounded clinical QA」這兩個方向。

- 是否有引用、證據標記或其他可追溯機制,原始資料未說明。

對開發者有什麼影響

如果你在做醫療 AI、企業內部知識助理、或任何需要依據來源回答的系統,這篇論文的訊號很清楚:不要只想著一次生成,而是要把任務拆開。先檢索,再篩選,再生成。這種設計雖然沒有單一端到端那麼簡潔,但通常更容易控管風險。

對產品或平台團隊來說,級聯式架構還有一個現實好處:可觀察性更高。你可以看是哪一段出了問題,是檢索沒撈到、排序不準、還是最後回答階段太自由。這對醫療場景特別關鍵,因為你不只要答案,還要知道答案怎麼來的。

但它也不是免費午餐。多階段管線通常代表更高的系統複雜度,也可能帶來更長延遲。每多一個 stage,就多一個失敗點。retrieval 做得好,不代表 answer generation 一定穩;反過來,生成器很強,也救不了前面撈錯證據的問題。

所以這篇論文最值得參考的地方,不是某個已經被數字證明的最佳解,而是它代表的工程判斷:在 EHR 這種高風險、長上下文、強依賴證據的任務裡,級聯式 grounded QA 很可能比單段式回答更合理。

還有哪些限制與未知

目前這份資料的限制很明顯。首先,我們不知道作者怎麼定義「grounded」。是只要答案來自檢索到的病歷片段就算,還是必須附上證據對應?這兩者在實作上差很多。

其次,我們不知道它處理的是結構化 EHR、非結構化病程紀錄,還是兩者混合。這會直接影響檢索設計,也會影響模型能不能穩定抓到關鍵資訊。再來,摘要沒有提到模型規模、prompt 設計、評估方法或錯誤分析,所以無法判斷這個 cascade 到底是哪一段最關鍵。

最後,從 raw 資料看不出它是偏研究競賽設定,還是偏可落地系統。這個差異很重要。競賽型系統通常可以針對特定指標優化;實際部署則更在意穩定性、延遲、審計能力和長期維護成本。

總結來說,這篇論文提供的是一個很明確的方向:用級聯式 LLM 管線,把 EHR 問答做得更 grounded。它沒有在摘要裡公開完整 benchmark 數字,所以現在還不能用成績來下判斷。但對開發者來說,這已經足夠傳達一個重要訊號:在臨床場景,答案能不能對到證據,往往比答案寫得多漂亮更重要。