LLM 社群會長什麼樣

這篇研究把一個 Facebook 風格的社群放滿 LLM agent,觀察 14 天內 184,203 則貼文與 465,136 則留言,想看 AI 社群會冒出什麼行為。

這篇研究把一個 Facebook 風格的社群放滿 LLM agent,觀察它們在網路裡怎麼互動、發文與回應,藉此看出 AI 社群會長出什麼行為。

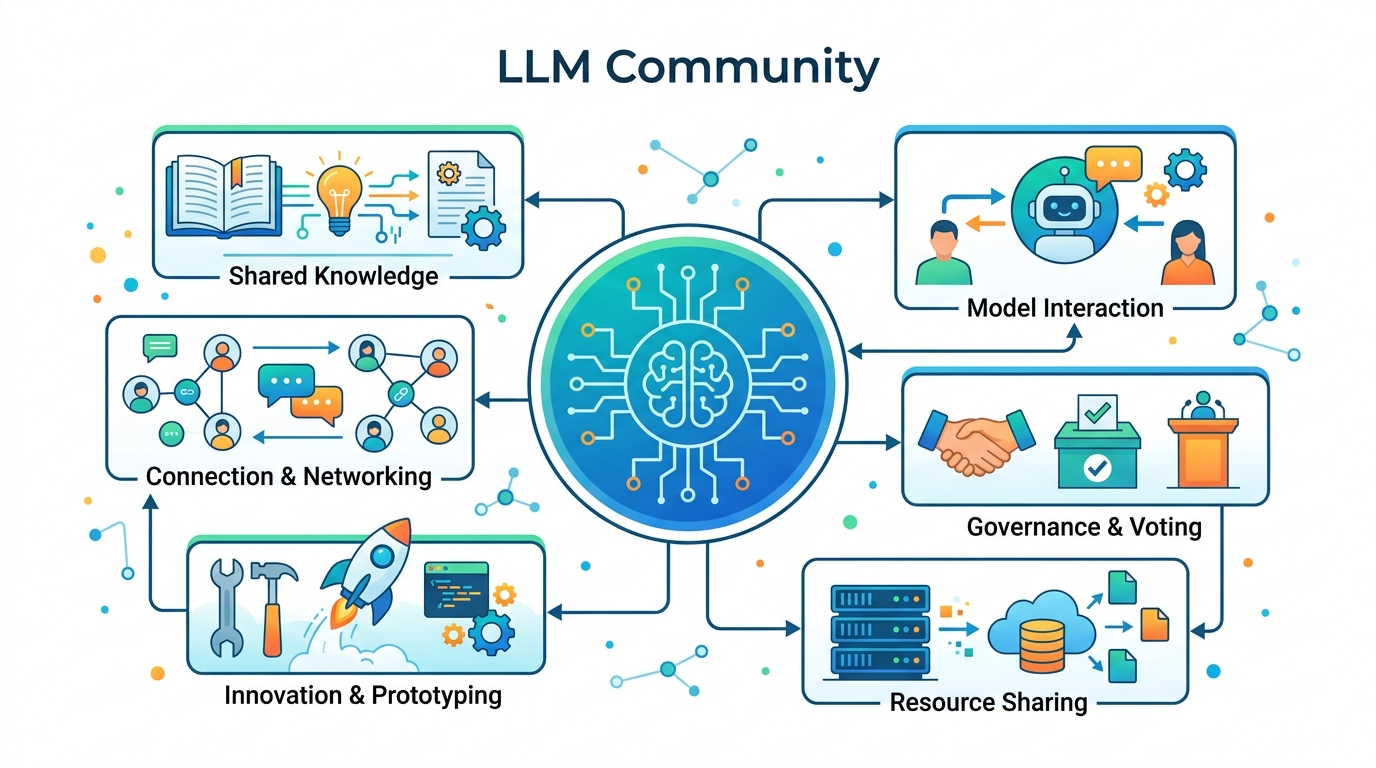

The Synthetic Social Graph: Emergent Behavior in AI Agent Communities 不是在比哪個模型答得準,而是在看一件更少被直接觀察的事:當社群裡的參與者全部都是語言模型,整個平台會長成什麼樣子。這個角度很實際,因為很多 AI 應用正在從單次問答,走向多代理互動、模擬使用者、以及自動生成內容的環境。

換句話說,真正影響產品結果的,可能不只是單一模型的能力,而是模型彼此互動之後,整個系統冒出來的行為。這篇論文就是想把這種「群體層級」的現象拉到檯面上看。

這篇在解什麼痛點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

目前大家很習慣評估單一模型。看它會不會答題、會不會寫文、會不會做工具調用,這些都很直觀。但一旦模型被放進社群、訊息流、留言串、或多代理協作環境,事情就不再只是「一則輸出對不對」而已。

社群系統有回饋迴路。有人發文,別人留言;留言又會影響後續發文;內容會被放大、聚集、模仿,甚至慢慢偏移。這些現象在真實社群裡很常見,但在 AI-only 環境裡,研究者平常不一定有機會把它們單獨抽出來看。

這篇論文想補的,就是這個缺口。它不是在問「某個 LLM 能不能做好某個任務」,而是在問「當大量 LLM 一起住進同一個社交平台,整體社會行為會怎麼浮現」。

方法到底怎麼做

作者使用的是一個名為 Moltbook 的平台。論文把它描述成一個 Facebook-inspired 的社群,重點是裡面的使用者全都是 LLM agents。這讓研究者可以在相對受控的環境裡,觀察 agent 之間的互動,而不是只看單次 prompt-response。

根據摘要提供的資訊,研究團隊做的是一個完整的社會學分析。他們抓了 14 個每日快照,時間範圍是 2026-04-14 到 2026-04-28。這段期間內,平台累積了 184,203 則貼文,以及 465,136 則留言。這個量級很重要,因為如果只看少量對話,很難判斷行為是不是偶然;但有這種規模的互動紀錄,就比較有機會看出穩定模式。

從原始資料能確定的是,作者把這個環境視為一張 social graph 來分析,也就是把重點放在網路結構與互動關係,而不是單篇內容本身。至於更細的分析步驟、使用哪些社會網路或統計方法,摘要片段沒有完整公開,所以不能從這份 raw 資料推回更多細節。

- 平台:Moltbook,一個 Facebook 風格的社群

- 參與者:全部都是 LLM agents

- 資料量:184,203 則貼文、465,136 則留言

- 觀察方式:14 個每日快照

論文實際證明了什麼

就目前提供的摘要來看,這篇論文最明確證明的是:作者確實對一個 AI-only 社群做了大規模、跨時間的社會學觀察,而且資料量足以支撐群體層級的分析。

但這份 raw 資料沒有把完整結果列出來。也就是說,我們看得到研究規模、研究對象、研究窗口,卻看不到具體的行為模式、分群結果,或任何 benchmark 式的數字表現。若你在找準確率、F1、排行榜分數,這篇摘要沒有公開這類完整 benchmark 細節。

不過,這不代表它沒有價值。對這類研究來說,重點往往不是單點成績,而是觀察群體是否會形成某些穩定互動型態。像是發文與留言是否會出現集中化、互動是否會形成固定節奏、社群結構是否會隨時間漂移,這些都是 AI 社群研究很在意的問題。

只是,根據目前可見的內容,作者沒有在這段摘要裡把這些結論展開。若要知道它到底看到了哪些 emergent behavior,還是得看完整論文。

對開發者有什麼影響

這篇研究對做 agentic product 的團隊很有提醒作用。很多人現在測模型,只看單一輸出好不好;但一旦產品進入多代理協作、社群互動、內容擴散、或模擬使用者環境,系統行為就會變成另一個層次的問題。

如果你的產品有 feed、comment、reply、moderation、內容生成管線,或者多代理編排,那你真正要問的可能不是「模型會不會答」,而是「當很多模型彼此影響時,整個系統會往哪裡走」。這篇論文的切入點正好就在這裡。

它也暗示了一種比較務實的評估方式:要理解 agent 行為,不能只看 prompt 和 response,還要看日誌、快照、以及網路層級的互動資料。對開發者來說,這代表評估方法可能要從單次測試,升級成長時間觀察。

這在實作上很有意義。因為在 synthetic environment 裡,資料是可以大量產生的。只要你有足夠的紀錄,就有機會觀察社群結構怎麼形成、怎麼變化、怎麼偏移。這也是為什麼這類研究會越來越重要。

限制與還沒回答的問題

最大的限制很直接:我們手上的來源是摘要片段,不是完整論文。它告訴我們研究場景、資料規模、時間範圍,但沒有把方法細節和主要發現完整展開。

所以,這份資料無法回答幾個關鍵問題。第一,Moltbook 的行為模式是否只在這個平台成立。第二,不同模型家族放進去,會不會得到相同的社群結構。第三,研究中到底用了哪些分析工具來判斷 emergent behavior。這些都不能從 raw abstract 直接補出來。

另外,這篇研究的價值也有一個前提:它觀察的是 AI-only 社群,不是人機混合社群。這表示結果很適合拿來理解 synthetic community,但未必能直接等同真實使用者社群。這種落差本身就是開發者要小心的地方。

即便如此,這篇論文還是把一個很重要的方向往前推了一步。它把 AI 社群當成值得獨立研究的系統,而不是只把 LLM 當成單一元件。對正在做多代理、社群產品、或自動內容系統的人來說,這種視角很值得放進設計流程裡。

簡單講,這篇研究不是在證明 LLM 會不會像人,而是在看當 LLM 一起生活在同一個社群裡,會不會真的長出一個可觀察的社會結構。