2026 年 MLOps 架構與策略指南

2026 年的 MLOps 重點在治理、LLMOps 整合與成本控制。企業已把 AI 放進 production,但多數還卡在試點到擴張的落差。

2026 年的 MLOps 重點是把 AI 穩定放進 production,還要管治理、成本和監控。

說真的,這題已經不是模型訓練而已。很多企業早就把 AI 上線了,但真正能擴到全公司的人不多。

原文提到,87% 的企業已經有 AI 在 production。可是,能跨過試點、真正擴張的不到 40%。這個落差很大,也很現實。

| 指標 | 數值 | 意義 |

|---|---|---|

| AI 在 production 的企業 | 87% | AI 已經是營運工具,不是實驗品 |

| 能擴出試點的企業 | <40% | 多數團隊卡在落地前半段 |

| AI Act 最高罰則 | 全球營收 6% | 治理不只是流程問題,也是財務風險 |

| 某次稽核中的 production models | 247 | 模型盤點與 ownership 很重要 |

| 同次稽核中有文件的模型 | 89 | 沒文件的 AI 會留下合規洞 |

MLOps 到底在管什麼

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

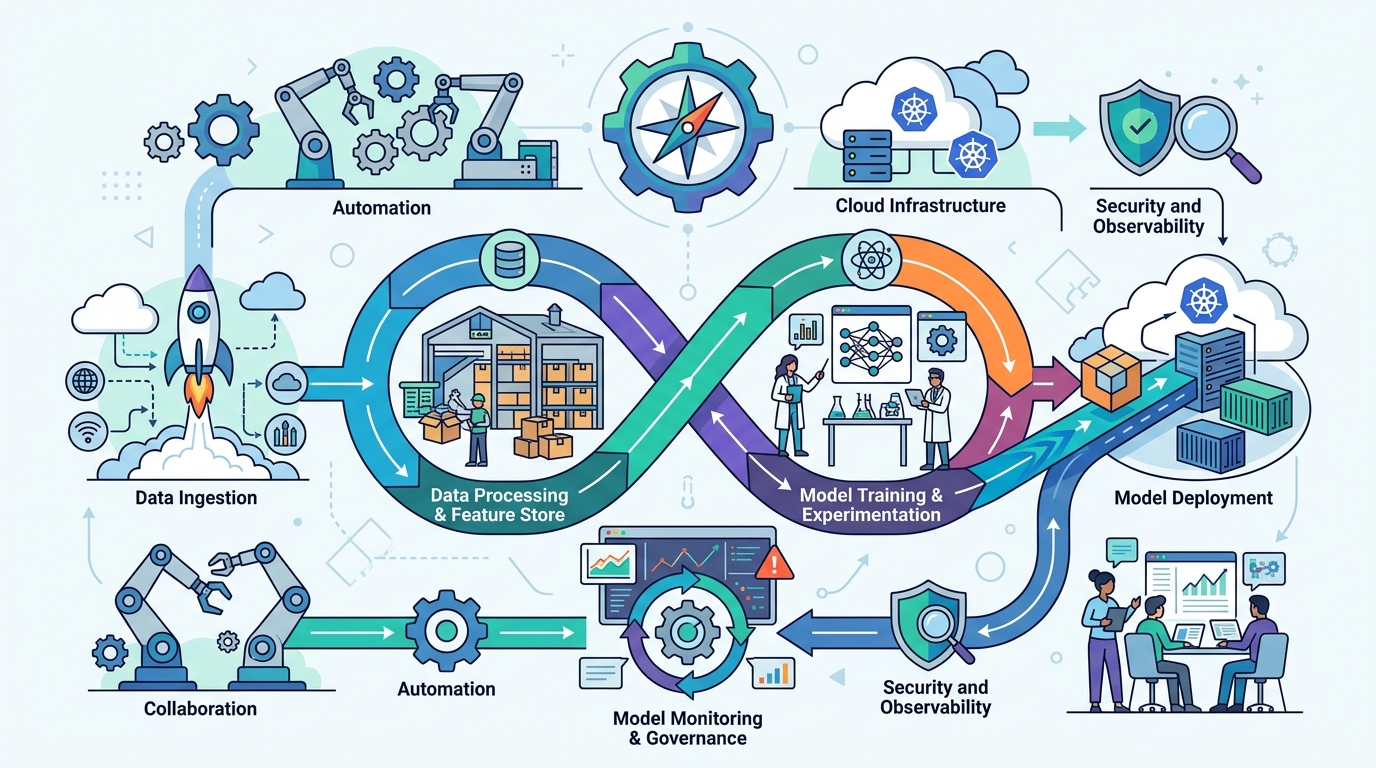

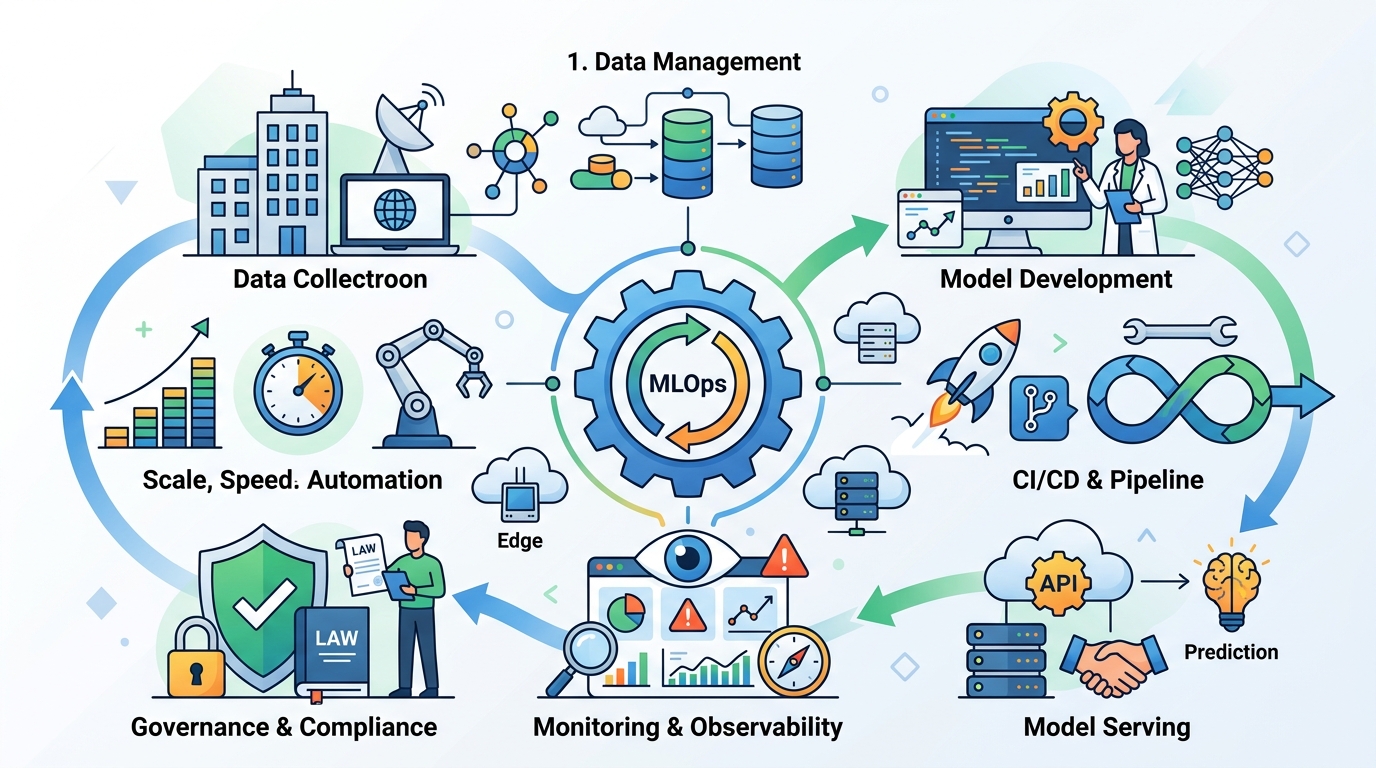

MLOps,講白了就是把機器學習系統管到能長期跑。它管的不只是訓練,還有部署、監控、重訓、版本控管和治理。

很多人以為模型準就夠了。其實不是。模型通常只佔整個系統 5% 到 10%。剩下的都是資料驗證、基礎設施、可觀測性、權限和回饋迴路。

這也是為什麼很多 demo 很漂亮,上線後卻翻車。不是演算法太爛,而是資料髒、延遲高、監控沒做、責任沒切清楚。

- 資料品質要持續檢查,不是一次清完就沒事。

- 監控要看 drift、延遲、成本和業務指標。

- 治理要直接放進流程,不要最後才補簽核。

- 模型 ownership 要清楚,不然出事沒人接。

從 2022 到 2026,架構怎麼變

早期的 MLOps 比較像 pipeline 自動化。大家把訓練流程接起來,送去 serving,然後祈禱不會炸。

現在不一樣了。企業要的是整套平台。像 MLflow、Kubeflow、Databricks 這類工具,已經不只管實驗,還要管資料流、模型註冊、部署和追蹤。

服務層也一樣。KServe 和 Seldon 這類方案,重點是讓模型在線上穩定提供推論。對台灣很多團隊來說,這比單純追 benchmark 更重要。

- 從單一模型流程,變成平台化運作。

- 從手動部署,變成 CI/CD/CT。

- 從只看 accuracy,變成看整體服務品質。

- 從單一 ML,變成 ML、LLM、agent 一起管。

為什麼 LLMOps 和 AIOps 會混進來

現在的 MLOps,已經很難只管傳統 ML。LLM 一上來,問題就多了 prompt injection、hallucination、內容安全、retrieval 品質。

再加上 AIOps,又會碰到 logs、traces、incident 和 root cause analysis。三者的工具開始重疊,但風險沒有變少,只是長得更像了。

原文有一句我很同意:模型可能只佔系統 5% 到 10%。這句話很刺耳,但很真。你如果只會調參,不會管服務,最後還是會被 production 打臉。

“The model is maybe 5–10% of an ML system.”

- MLOps 看 drift、accuracy、latency。

- LLMOps 看 safety、prompt leakage、output quality。

- AIOps 看 anomaly、incident、修復速度。

- 治理層要共用,但權限和風險要分開。

2026 年最該注意的幾個數字

這部分很現實,因為它直接碰到錢和法規。EU AI Act 這類規範,已經把 auditability 拉成硬需求。

原文提到,違規最高可到全球營收的 6%。這不是小錢。對大公司來說,這會直接影響法務、資安和平台團隊的決策。

成本也是大事。GPU 很貴,尤其是一直訓練大模型,或是用昂貴 inference 跑大量請求時。原文提到,透過 spot instances、distillation 和 chargeback,成本可以比放任式管理少 40% 到 60%。

- Edge AI 會逼你處理壓縮、聯邦學習和 OTA 更新。

- 自動重訓會取代固定排程。

- Arize AI、WhyLabs、Fiddler AI 這類工具,會補上通用監控做不到的事。

- FinOps 會跟 MLOps 綁得更緊。

企業最常卡住的地方

很多團隊不是技術不行,是流程太亂。原文點出四個常見卡點:資料孤島、人才不足、模型爆量、標準不一致。

這些問題在台灣也很常見。部門各做各的,命名亂掉,版本亂掉,最後連哪個模型在 production 都說不清楚。

更麻煩的是 shadow AI。業務團隊覺得官方流程太慢,就自己開帳號上。這不是單純違規,而是正式流程比繞路還難用。

- 資料孤島要靠管理層,不是只買 catalog 工具。

- 自助平台可以減少對稀有人才的依賴。

- reference architecture 能把團隊拉回同一套標準。

- 模型 inventory 要定期盤點,不然 audit 會很難看。

如果你要做 MLOps 策略

先做 inventory。把所有 production models、部署方式、資料來源列出來。沒盤點,就沒治理。這句很土,但很實用。

再做風險分級。信用、招募、醫療這種場景,不能跟一般分析模型用同一套規則。高風險就要更嚴的監控和審核。

接著切角色。資料科學家管模型品質,ML engineer 管延遲和可靠性,platform engineer 管開發體驗,資料工程師管 pipeline。別幻想一個人全包。

工具選型也別亂。小團隊或單雲環境,可以走雲原生平台。工程能力強的團隊,可以用開源堆疊。金融、醫療、政府這種場景,則要把治理和監控放前面。

如果你想看成熟度,原文的分級很適合拿來當內部標準。Level 3 是 CI/CD/CT 加 drift detection。Level 4 是多租戶自助平台。Level 5 則是 policy-driven automation,甚至接近 self-healing pipelines。

跟其他方案比,差在哪

很多公司會把 MLOps、LLMOps、AIOps 混在一起談。這樣很危險,因為看起來一樣,實際上問題不同。

傳統 MLOps 比較像資料和模型的工程問題。LLMOps 比較像內容風險和控制問題。AIOps 比較像維運和事件處理問題。三者共用底層平台,但不能用同一套指標硬套。

如果只看模型準確率,你會錯過成本、延遲、可解釋性和合規。這也是為什麼很多團隊在 demo 階段很順,真的進 production 就開始亂。

- 傳統 ML:重 accuracy、drift、latency。

- LLM:重 safety、retrieval、prompt 管理。

- AIOps:重 incident、trace、告警品質。

- 企業平台:重治理、成本、權限和可追蹤性。

這波變化代表什麼

我覺得 2026 年的 MLOps,已經變成 AI 營運控制系統。它不是開發附屬品,而是產品的一部分。

如果你的團隊還在用手寫 script 上線模型,然後等使用者抱怨才看監控,那就該停一下。先盤點現況,再補監控,最後才談擴張。

接下來 12 個月,最值得做的事很直接:把 production inventory 做完整,把高風險模型先納管,把成本和品質一起看。別再只問模型準不準。你要問的是,它能不能在下個季度、在稽核下、用可接受的成本繼續跑。