選擇性 LLM 正則化推薦器

這篇論文在談怎麼把 LLM 當成訓練時的輔助訊號,選擇性地做正則化,提升推薦模型,但不必重寫整套推薦系統。

這篇論文在談怎麼把 LLM 當成訓練時的輔助訊號,選擇性地做正則化,提升推薦模型,但不必重寫整套推薦系統。

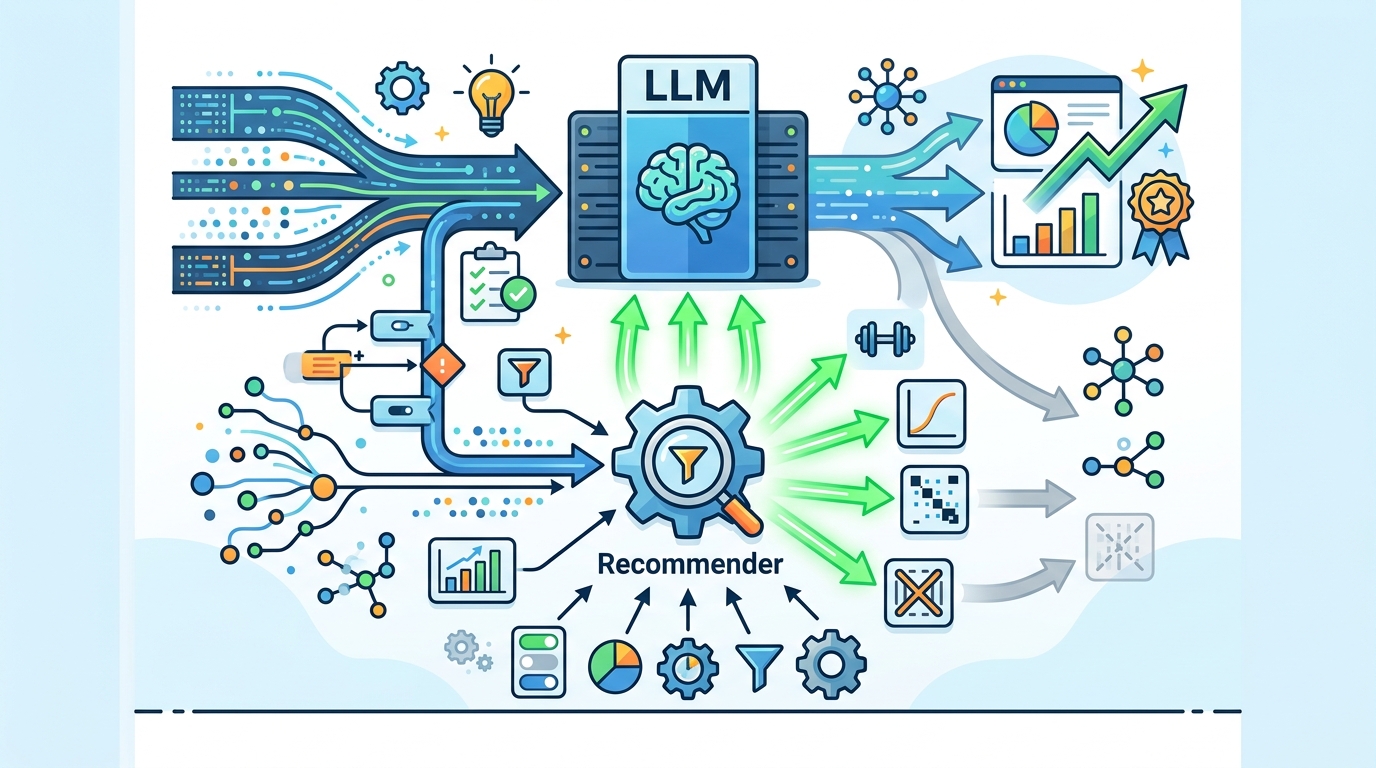

這篇 Selective LLM-Guided Regularization for Enhancing Recommendation Models 的切入點很直接:推薦系統已經很複雜了,能不能把大型語言模型拉進來幫忙,但又不要把整條 pipeline 變成一次昂貴的大改造。作者提出的方向,是把 LLM 當成訓練時的指導來源,然後用「選擇性」的方式去做 regularization,而不是把這個訊號灑滿整個模型。

這個思路對做推薦的人來說很實際。推薦模型常常已經在 production 裡跑得很久,資料流、特徵、線上延遲、監控方式都綁得很緊。你要它整套換成 LLM 驅動的架構,成本通常太高。若是只在訓練階段注入一些額外訊號,還能控制介入範圍,落地機會就大很多。

這篇論文想解哪個痛點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

從目前提供的 raw 資料來看,沒有完整 abstract、沒有 benchmark 表,也沒有數字化結果。也就是說,我們不能從這份來源直接確認它在哪些資料集上測了什麼、提升了多少、或用了哪些評估指標。能安全確認的是問題方向:推薦模型需要額外語意或偏好訊號,但又不想為了這個訊號把系統重做一遍。

這其實是推薦場景很常見的矛盾。一方面,模型想要更懂使用者與物品之間的語意關係;另一方面,線上系統又很怕複雜度上升。LLM 很會補語意,但如果每次推論都要呼叫 LLM,成本和延遲就會很難看。作者這裡不是要把 LLM 直接塞進推薦器當主引擎,而是把它當成一種訓練時的輔助信號,去約束或引導原本的推薦模型。

白話一點說,這篇不是在提「LLM 取代 recommender」,而是在提「LLM 幫 recommender 校正方向」。這種定位很重要,因為它比較符合真實工程環境:你想吃到語意模型的好處,但不想付出完整 LLM 系統的維運代價。

方法到底怎麼運作

從標題可以拆出兩個關鍵字:LLM-guided,以及 selective regularization。Regularization 本來就是訓練時常見的做法,核心是加上一個額外約束,讓模型不要太容易過擬合,或讓它朝某個你希望的方向學習。這裡多出來的訊號來自 LLM,表示 LLM 可能扮演某種老師、約束來源,或輔助判斷器的角色。

而 selective 的意思,是這個正則化不是無差別套用。它比較像是挑地方下手:只在某些樣本、某些配對、某些訓練情境下用 LLM 的指導。這樣做的工程動機很清楚。第一,避免過度正則化,免得模型被限制得太死。第二,避免把昂貴的 LLM 訊號浪費在不需要的地方。

不過,這份 raw 資料沒有把具體機制寫出來,所以我們不能替作者補細節。它沒有說明 LLM 產生的是文字理由、偏好約束、相似度訊號,還是 sample weight;也沒有說明 selective 的判斷規則是什麼。能確定的只有方法論層次:用 LLM 來提供訓練引導,再用選擇性套用來控制成本與副作用。

如果把這個設計翻成開發者熟悉的語言,它像是在做「高價訊號的局部使用」。不是每個 batch 都灌同樣份量的外部智慧,而是把它放在最可能影響模型品質的地方。這種設計通常是為了同時處理兩個問題:訊號太強會壓壞原模型,訊號太廣又會讓訓練成本失控。

論文實際證明了什麼

這裡要先講清楚:目前提供的來源沒有公開完整 benchmark 細節,所以無法整理出具體數字、資料集名稱、或和哪些 baseline 比較。也不能從這份 raw 資料中直接下結論說它「提升了多少」。如果你要找的是可量化的實驗結果,這份摘要資訊不夠。

但即使沒有數字,這篇論文仍然傳達了一個明確方向:LLM 不一定要以推論服務的形式進入推薦系統,也可以只在訓練階段發揮作用。這代表研究重點不只是模型效果,還包含系統整合方式。對推薦場景來說,這種訓練時介入、推論時不一定依賴 LLM 的做法,通常比全面重構更容易被接受。

也就是說,這篇目前能支持的結論比較像是「方法設計上的可行路線」,而不是「已被完整驗證的產品級方案」。如果後續全文有實驗,真正值得看的會是它到底改善了哪種推薦品質:排序、泛化、穩定性、還是某種對長尾樣本的表現。但就現有資料而言,這些都還不能補寫成事實。

- 可以確認:主題是 recommendation models。

- 可以確認:方法用 LLM-guided regularization。

- 可以確認:正則化是 selective,不是全面套用。

- 不能確認:benchmark、數字結果、資料集與指標。

對開發者有什麼影響

對台灣開發者來說,這種研究最有意思的地方,不是它有沒有把某個分數刷高,而是它暗示了一種比較務實的整合方式。很多團隊都知道 LLM 很強,但也知道把 LLM 直接放進線上推薦流程,通常會碰到延遲、成本、可觀測性、以及維運複雜度問題。若 LLM 只在訓練時提供 guidance,系統壓力就小很多。

這也讓「selective」變得很重要。真實推薦系統裡,昂貴訊號通常不會平均分配。你可能只想在冷門 item、稀疏互動、語意模糊的案例、或難判斷的樣本上加強約束。選擇性 regularization 的概念,和這種工程直覺是對得上的:把資源花在最值得的地方,而不是全面撒網。

如果這個方法真的有效,對架構設計的意義會是:LLM 可以從「推論依賴」變成「訓練輔助」。這個轉變很關鍵。因為一旦 LLM 不再是 production path 的必要元件,很多團隊就有機會把它當成離線工具來用,部署門檻會低很多。

限制和未解問題

這篇目前最大的限制,不是方法本身,而是來源資訊不完整。沒有 abstract 全文,沒有實驗段落,沒有清楚的訓練流程。這讓幾個關鍵問題都還沒答案。

第一,LLM-guided 到底是怎麼產生的。是用自然語言解釋、偏好排序、相似 item 提示,還是其他形式?第二,selective 的規則是什麼。是依照資料難度、置信度、樣本類型,還是某種門檻機制?第三,訓練成本是多少。如果每次都要呼叫 LLM,省下來的推論成本可能會被訓練成本吃掉。

還有一個很現實的問題是訊號品質。LLM 的建議不一定總是穩定,尤其在特定領域或特定資料分布下。若它的 guidance 帶有雜訊,selective 使用確實可能降低傷害,但也可能讓整體行為變得更難解釋。這些都是推薦系統很在意的點。

所以,這篇論文目前最值得記住的,不是某個已經證實的數字,而是它提出的研究方向:把 LLM 當成推薦模型的訓練輔助,並且只在必要時介入。對工程團隊來說,這是個很符合現實約束的想法,但在沒有完整 benchmark 和方法細節前,還不能把它當成可直接上線的答案。

如果你在做推薦系統,這篇的價值在於提醒你:LLM 的用途不只是在生成內容或做推論,也可以是訓練階段的約束來源。真正要判斷它值不值得導入,還是得回到幾個老問題:它改善了什麼、花了多少、會不會增加系統複雜度,以及這些代價值不值得。