怎麼評估 Kimi K2.6 寫程式

這篇教你把 Kimi K2.6 接到現有開發流程,實測寫程式、代理式工作流與成本,最後做出是否切換的決定。

這篇教你把 Kimi K2.6 接到現有開發流程,實測寫程式、代理式工作流與成本,最後做出是否切換的決定。

這篇給開發者、平台工程師、AI 產品團隊看,目標是用你自己的程式庫與任務來評估 Kimi K2.6。照著做完,你會拿到可用的 API 連線、一次可重複的測試方案、成本對照表,還有一份可直接採用的上線判斷。

本文依據 Hugging Face 模型頁 與 Moonshot API 文件,把模型接入、編碼測試與成本核算串成一條可執行流程。

開始之前

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

- Moonshot AI 或 OpenRouter 帳號

- Kimi K2.6 的 API key

- Node 20+ 或 Python 3.11+

- 可安全測試的程式庫或 staging 專案

- Git 2.40+ 已安裝

- 現有模型的成本資料,例如 Claude、GPT 或 Gemini 用量

Step 1: 建立 Kimi API 連線

目的:先把 Kimi K2.6 接進你的現有客戶端,讓後續測試只改 provider,不改整個應用架構。

export MOONSHOT_API_KEY="your-key-here

echo

auth

over API_BASE_URL="https://api.moonshot.ai/v1"如果你用 OpenAI SDK,保留原本 client 形狀,只把 base URL 指向 Moonshot。若你走 OpenRouter,就改成它的 endpoint 與模型名稱。驗收時,你應該看到一個簡單 prompt 回傳正常,且程式其他邏輯不需要重寫。

Step 2: 選一個真實程式任務

目的:不要用玩具題,直接拿你團隊真的會遇到的 bug、重構、元件遷移或相依套件升級來測。

把任務限制在一個可審核範圍內,並要求模型同時輸出 patch、變更說明與受影響檔案清單。這樣你才能比較 diff 品質、人工審查時間與修正次數。驗收時,你應該看到一份可讀的差異檔、簡短理由,以及至少一個可打開檢查的檔案層級變更。

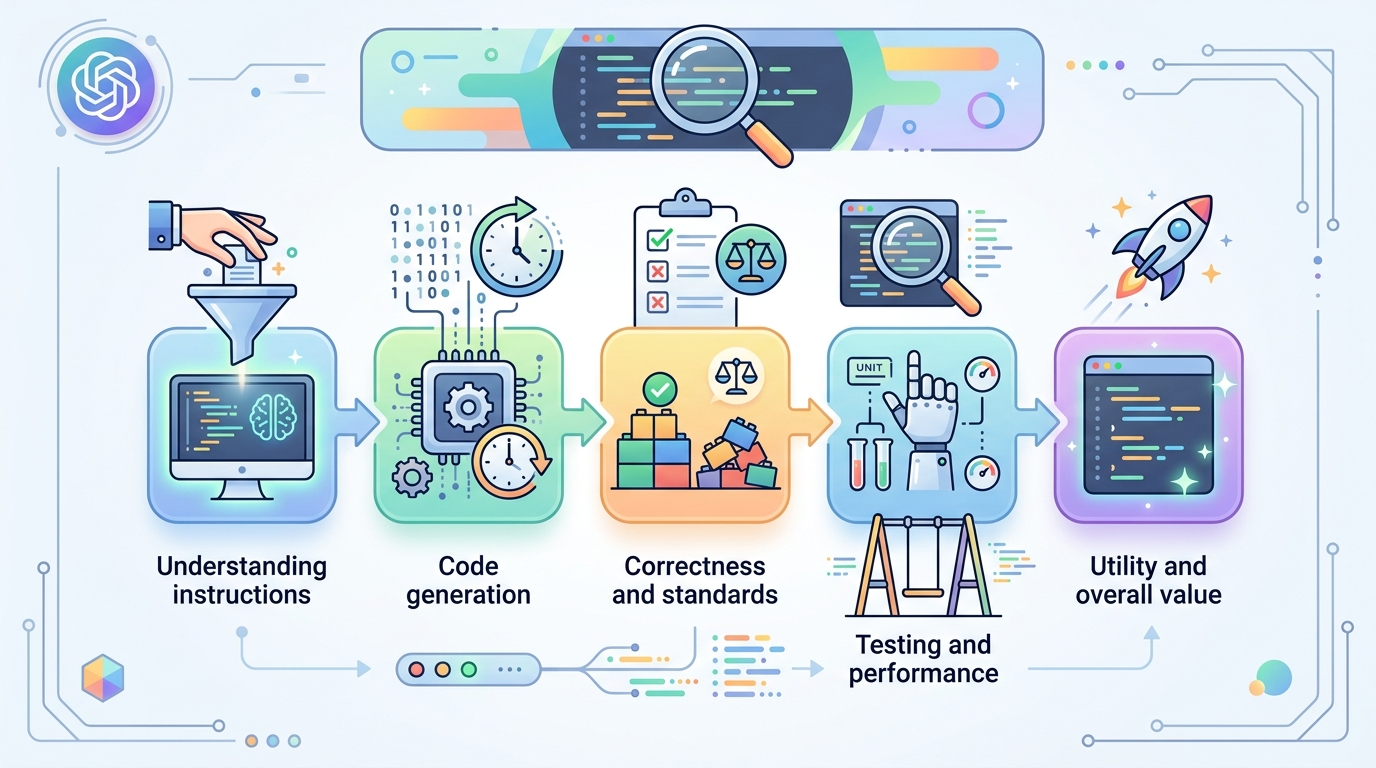

Step 3: 跑一次代理式多步流程

目的:測 Kimi K2.6 是否能撐住長流程工作,例如搜尋、規劃、編輯與驗證連續進行,而不是只會一次性回答。

你可以要求它先找出 bug,再檢查相關檔案、更新測試、處理失敗案例,最後整理剩餘風險。如果你的環境支援工具呼叫,就讓模型直接操作;如果不支援,就把命令輸出回填給它。驗收時,你應該看到它能連續跟著任務走完多個步驟,而不是中途偏題。

Step 4: 記錄成本與輸出量

目的:算出你的真實用量成本,而不是只看宣傳價格。Kimi K2.6 的輸入單價低,但 thinking 模式常會產生大量輸出,總成本會跟著變。

對同一個任務記錄 input tokens、output tokens、總耗時與重試次數,並把 Kimi 與你現在的模型做對照。若要評估 production use,至少重複三次。驗收時,你應該能看出低單價是否真的在你的工作型態下成立。

| 指標 | 基準/優化前 | 結果/優化後 |

|---|---|---|

| SWE-Bench Pro | GPT-5.4:57.7% | Kimi K2.6:58.6% |

| 整體 intelligence index | GPT-5.5:60 | Kimi K2.6:54 |

| Agent scale | K2.5:100 sub-agents,1,500 steps | K2.6:300 sub-agents,4,000 steps |

| API input price | Claude Opus 4.7:約 8.3x 更高 | K2.6:$0.60 / 1M input tokens |

Step 5: 寫下上線邊界

目的:把測試結果變成部署決策,而不是停在「感覺不錯」。Kimi K2.6 最適合寫程式、重構、代理式工作流,以及長工具迴圈比多模態能力更重要的場景。

如果它在你的 repo 上勝過現有模型,且成本可控,就先把它放進窄範圍工作流,例如修 bug 或產生 patch。若它在推理、視覺或穩定性輸掉,就把它保留成專用模型,而不是預設模型。驗收時,你應該手上有一份書面決策,並清楚寫出適用工作邊界。

常見錯誤

- 拿玩具 prompt 測試。修法:改用 production-shaped code 與真實 bug 或重構。

- 只看 input tokens。修法:同時記錄 output tokens,尤其是 thinking 模式。

- 把 benchmark 勝利當成全面勝利。修法:只拿 Kimi 比你真的會上線的工作流。

接下來可以看什麼

下一步可以做更接近 production 的試跑:把 Kimi K2.6 接到 staging agent,連續一週對照真實工單,並記錄它在哪些代理式任務上真的比你現在的 coding model 更有優勢。