Universal YOCO 想把深度做大但不爆 cache

YOCO-U 把 recursive computation 和 efficient attention 結合,想在推理時拉高有效深度,同時壓住 KV cache 成長與額外開銷。

大型語言模型要在推理時變得更會想,現在很常靠 test-time scaling,也就是多跑幾輪、多花一些計算,換更好的推理表現或 agent 行為。但問題也很直接:如果你沿用標準 Transformer 的做法,這種「多想幾次」通常不便宜,KV cache 也會跟著深度一起膨脹。

這篇 Universal YOCO for Efficient Depth Scaling 想處理的,就是這個老問題。作者的核心主張是:不要把更深的推理,建立在更重的 cache 和更高的重複計算成本上。它提出的方案叫 YOCO-U,目標是把 inference 時的有效深度拉高,但不要把 overhead 一起拉爆。

這篇論文在解什麼痛點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

摘要一開始就點出一個很實際的瓶頸:如果你想讓 LLM 在測試時表現更好,常見做法就是增加迭代次數,讓模型多跑幾輪。然而在標準 Transformer 裡,每多一輪都會增加計算量,而且 KV cache 也會隨著模型深度成長。結果就是,想要更會推理,代價可能是更高延遲、更大記憶體壓力,還有更難控制的推理成本。

這對開發者特別有感。因為 test-time scaling 的吸引力,在於你可以把算力花在更難的 prompt、長上下文任務,或是 agent 工作流上,而不是每次都固定燒同樣的成本。可是一旦 scaling 機制本身太貴,這個好處就會被吃掉。YOCO-U 就是針對這個矛盾來設計。

它不是單純在說「讓模型更大」,而是想回答另一個更務實的問題:能不能讓模型在推理時更深,但不要用傳統 Transformer 那種一路堆上去的方式?

YOCO-U 的做法是什麼

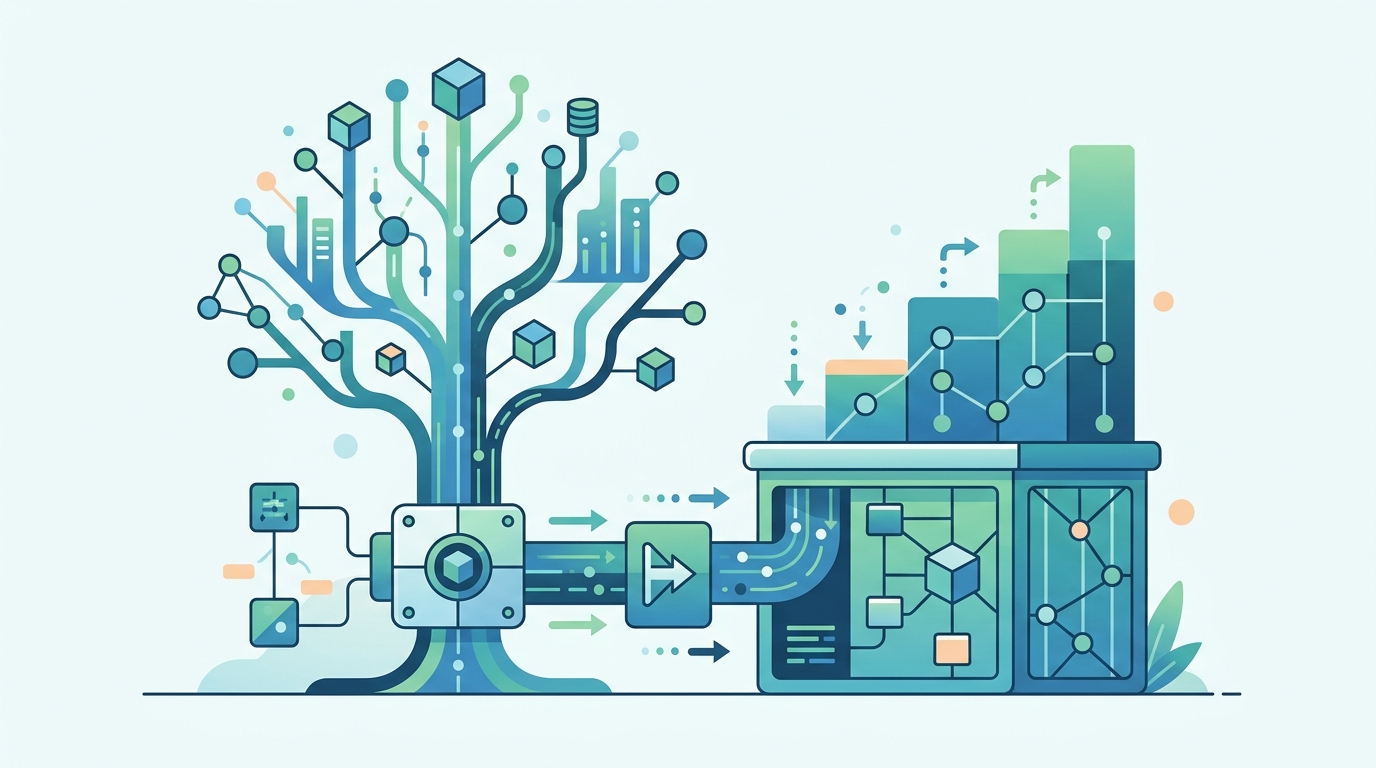

這篇論文的基礎是 YOCO 架構。摘要把 YOCO 描述成一種 decoder-decoder 架構,特點是有 constant global KV cache,還有 linear pre-filling。白話講,就是它在 cache 管理上走的是更省的路線,不走標準 Transformer 那種 cache 隨深度一路擴張的模式。

在這個基礎上,YOCO-U 再加上一個 Universal Self-Decoder。這個模組會透過 parameter sharing 做多次迭代。也就是說,它不是把每一輪都當成完全獨立的一段新計算,而是重複使用同一組參數,讓 recursive computation 成為可能。

更關鍵的是,這個遞迴不是全網路到處跑。摘要明確說,它把 iterative process 限制在 shallow、efficient-attention layers。這個選擇很重要,因為它想把 recursion 帶來的深度收益,集中放在相對便宜的區段,而不是把最重的部分也一起迭代下去。

如果用一句話整理,YOCO 負責把 cache 和 prefill 這件事做得比較省,recursive computation 則負責把有效深度補上來。YOCO-U 的賣點,就是把這兩個方向綁在一起。

為什麼要把 YOCO 和 recursion 合在一起

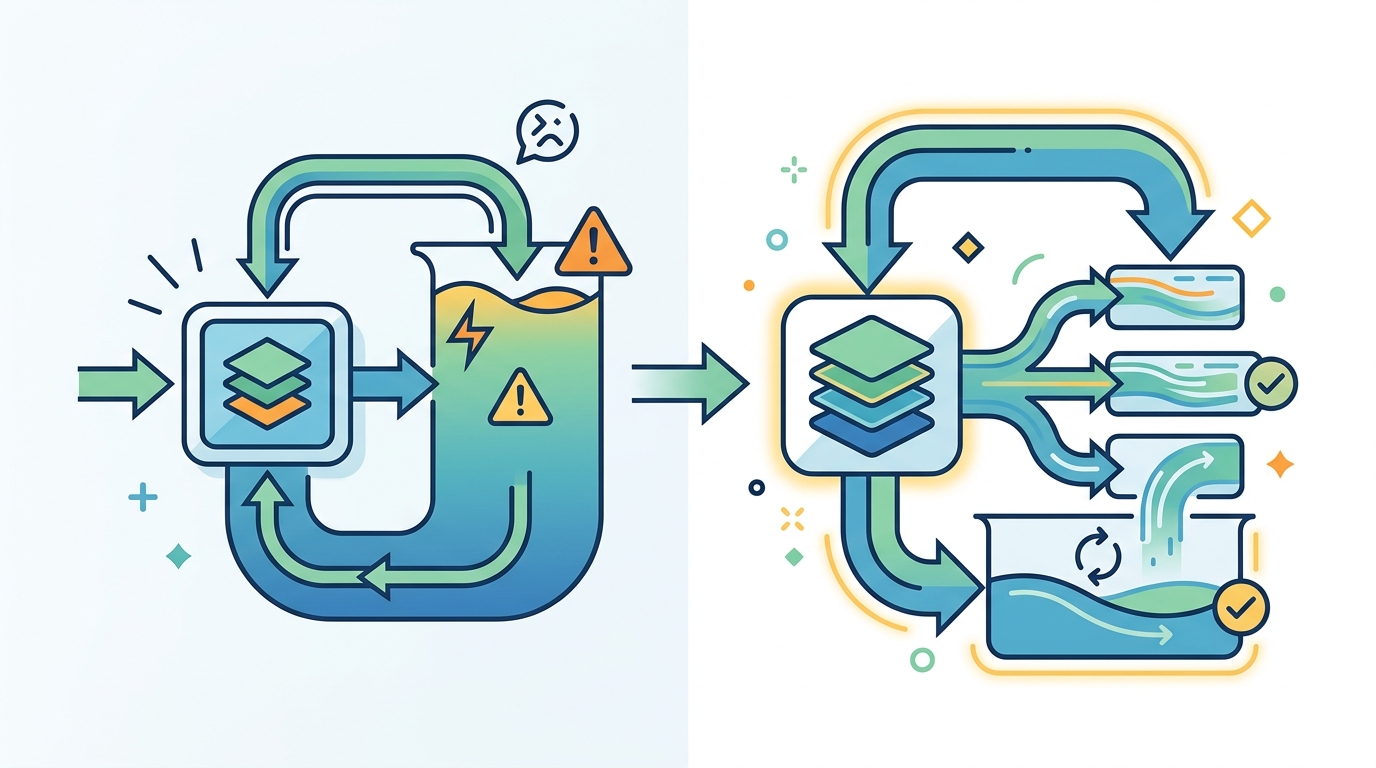

摘要的語氣很明確:YOCO 和 recursion 單獨看,都還不夠。YOCO 雖然有 efficient inference 的特性,但它本身沒有完整解決 test-time 需要更深計算的需求。反過來,recursion 可以提高有效深度,卻不會自動把重複計算的 overhead 消掉。

YOCO-U 的定位,就是把兩者中間那條線畫出來:讓模型可以迭代,但只在架構已經設計好、成本相對低的地方迭代。這種設計對做推理型應用的人來說很有吸引力,因為它不是單純鼓勵你「多跑幾次」,而是試圖回答「哪些地方值得多跑,哪些地方不值得」。

這也反映出一個很重要的系統觀念:更多 compute 不等於更好的 scaling。真正的成本曲線,取決於計算放在哪裡。attention、cache 管理、參數重用、重複 pass 的位置,這些都會影響最後的推理開銷。YOCO-U 想做的,是把這條成本曲線重新整理過。

論文實際證明了什麼

先講限制:這份摘要沒有公開完整 benchmark 細節,所以沒有辦法從摘要裡拿到具體分數、提升幅度、模型規模,或比較時的 compute budget。換句話說,現在能確認的是方向,不是完整工程數據。

不過摘要還是給了幾個重要訊號。它說,實驗結果顯示 YOCO-U 在 general benchmarks 和 long-context benchmarks 上都維持了高度競爭力。這代表作者至少想證明一件事:在追求更深推理的同時,模型不一定要在一般表現或長上下文能力上明顯掉隊。

摘要也提到,YOCO-U 可以改善 token utility 與 scaling behavior,同時維持 efficient inference。這句話的重點不是某個單一分數,而是整體 tradeoff。也就是說,它試圖讓每個 token、每次迭代、每一層計算都更值得。只是因為摘要沒有數字,這些結果目前只能當成方向性結論。

所以比較保守的讀法是:這篇論文提出了一種讓 test-time depth scaling 更省的方法,而且初步實驗看起來沒有把效能換掉。但它還沒有在摘要裡把完整比較條件攤開,讀者還是得等正文細節。

- YOCO-U 建立在 YOCO decoder-decoder 架構上。

- YOCO 的特點是 constant global KV cache 與 linear pre-filling。

- Universal Self-Decoder 使用 parameter sharing 做多次迭代。

- 迭代只放在 shallow、efficient-attention layers。

- 摘要沒有公開完整 benchmark 數字,只能確認它在 general 與 long-context benchmarks 上表現具競爭力。

對開發者有什麼影響

如果你在做 LLM 系統,這篇論文的啟發其實很直接:test-time scaling 不一定要靠把整個 Transformer stack 重跑一遍。YOCO-U 嘗試的是另一條路,先用架構把 cache 壓住,再把迭代計算放到比較便宜、也比較可能有效的區段。

這對長上下文應用、推理型助理,或 agent 工作流都可能有意義。因為這些場景常常會遇到同一個現實:你確實想讓模型多想一點,但 latency 和 memory 不是無限的。YOCO-U 並沒有宣稱一口氣解決所有問題,但它至少提供了一個更可控的方向。

同時,這篇摘要也留下不少實作上的空白。像是不同 model size 下效果會不會一致、shallow layers 要怎麼選、迭代次數增加後效率曲線怎麼變,摘要都沒有交代。對部署團隊來說,這些都很重要,因為理論上省,不代表線上就一定省。

另外,因為摘要沒有 benchmark 數字,所以目前也很難拿它跟其他 test-time scaling 方法做嚴格比較。你只能知道它的設計理念是「把深度做得更便宜」,但還不能只靠摘要就判定它是不是最佳解。

這篇論文的實際價值在哪

YOCO-U 的價值,不在於它把模型變得更大,而在於它重新定義了「更深」這件事。它想證明,深度可以是 inference 時的工具,但前提是你要把 cache 成長和重複計算成本一起管好。這是很系統層的思路,不是單純調參而已。

對產業來說,這類方法會越來越重要。因為大家都在往 reasoning、agent、長上下文方向走,而這些方向的共同特徵,就是「更需要 test-time compute」。如果未來真的要把這種 compute 變成標配,那架構本身就得能吸收額外計算,卻不要讓 memory 和 latency 一起失控。

YOCO-U 目前看起來就是朝這個方向前進的一個嘗試。它不是 brute-force 地堆深度,而是把 recursion 限縮在較省的區塊,再用 YOCO 的 cache 設計去減少推理負擔。從工程角度看,這種拆法比單純加層數更值得注意。

總結來說,這篇論文想處理的不是「模型能不能更強」這麼空泛的問題,而是「模型能不能在不爆成本的前提下,於推理時變得更深」這個更實際的問題。摘要目前沒有提供完整 benchmark 數字,所以還不能下太滿的結論,但它的方向很清楚:如果 test-time scaling 會繼續成為主流,那麼讓深度變便宜,會是下一階段很重要的架構題目。