為什麼針對領域任務微調 LLM 才是預設選項

當 LLM 必須在特定領域做到高準確、固定格式與穩定輸出時,微調比只靠提示工程更適合作為預設選項。

當 LLM 必須在特定領域保持高準確與固定輸出時,微調比只靠提示工程更適合作為預設選項。

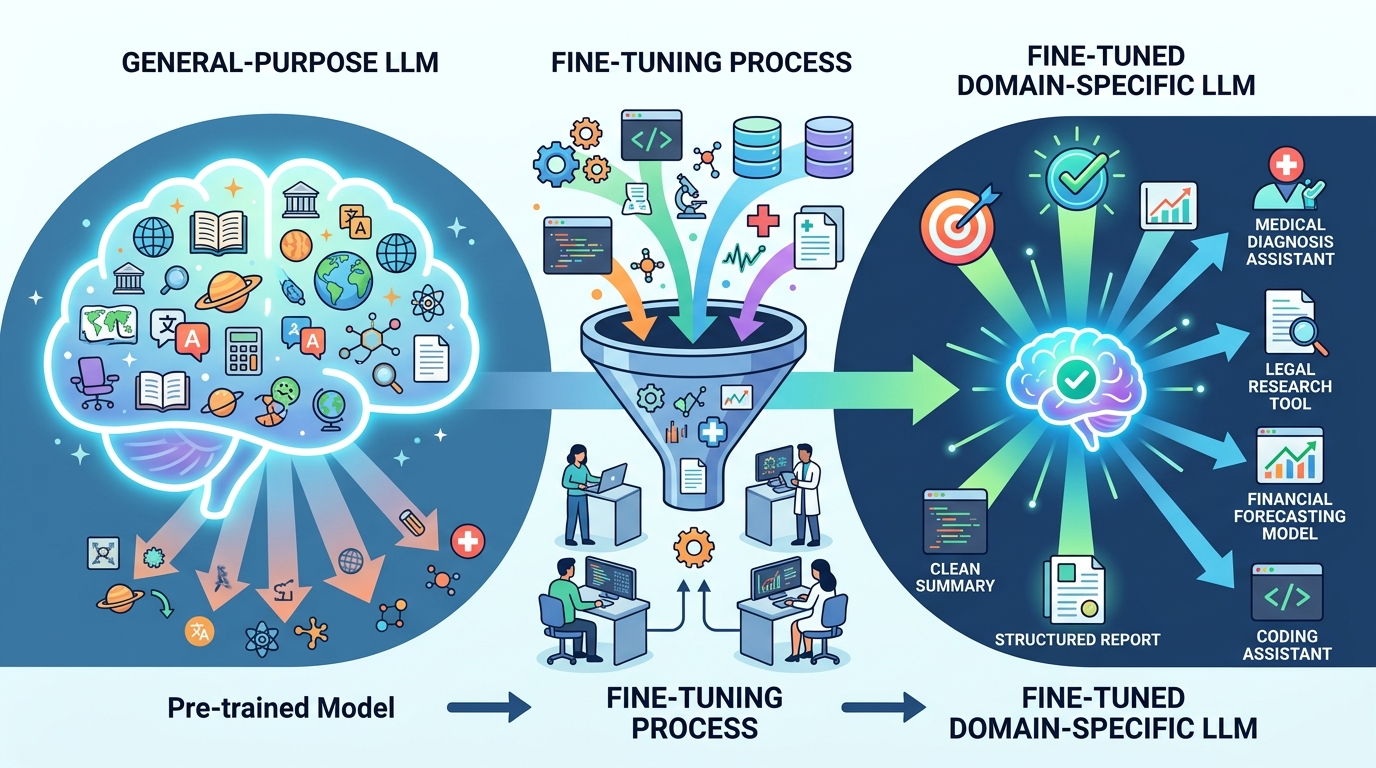

我主張,面對醫療、法務、金融、客服這類有明確規則的任務,微調 LLM 應該是預設方案,而不是最後才補上的選項。原因很直接:通用模型擅長廣泛對話,卻不保證在專業語境裡穩定命中格式、術語與判斷標準。

你可以把這件事理解成產品工程,而不是模型迷信。當任務輸入與輸出都相對固定時,真正有價值的不是模型「什麼都會一點」,而是它能不能在 95% 以上的重複情境中,維持一致、可驗證、可回歸測試的表現。

第一個論點:領域資料比通用廣度更有用

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

通用 LLM 的優勢是語言能力,但在專業場景裡,語言流暢不等於答案正確。像保險理賠分類、客服工單路由、合約條款標記這類任務,真正重要的是標籤一致性與術語對齊。你只要看過一個模型把「取消續約」誤判成「退款申請」,就會知道這不是小錯,而是直接影響流程成本。

微調的價值,在於它會把正確案例的模式寫進模型權重,而不是每次都依賴臨場提示。這也是為什麼在文本分類、情緒判斷、資訊抽取這些任務上,微調後的模型常常比純提示更穩。資料集如果有 5,000 筆到 50,000 筆高品質標註,通常就足以讓模型學到領域邊界,效果往往比把 prompt 寫得更長更可靠。

更重要的是,領域任務的失誤成本通常不對稱。醫療摘要少一個否定詞,法務審查漏掉一條例外條款,金融分類把高風險客戶歸錯類,這些都不是「再問一次」能補救的。微調不是追求炫技,而是把模型往可控、可重現的方向拉,這才符合真實產品的需求。

第二個論點:微調比硬拗通用模型更省成本

從零訓練一個模型,對多數團隊來說都不現實。微調的優勢是站在既有預訓練能力上做專精,你不用重建語言能力,只需要把成本花在你真正關心的任務上。這不只是省算力,也省標註、試錯與上線時間,對小團隊尤其關鍵。

以實務節奏來看,通用模型加上複雜提示,常常會把成本轉移到工程端。你得維護更長的 prompt、更複雜的檢索流程、更多防呆規則,還要處理版本漂移與回歸測試。相較之下,一個針對固定任務微調過的模型,雖然前期要整理資料,但上線後的行為更單純,維運與測試也更容易標準化。

這會直接影響產品迭代速度。當你要同時支援客服回覆、文件分類、欄位抽取三種任務時,與其把同一個通用模型硬拉去做所有事情,不如分別微調不同版本,讓每個模型專注在單一目標。對團隊來說,這代表更少的 prompt 債務,也代表更清楚的品質責任歸屬。

反方可能怎麼說

反對者最強的論點,是微調會讓系統變得更脆弱。若你的任務變化很快、標註資料又少,或工作本質上偏對話式與探索式,那麼先用提示工程、RAG 或工具調用,確實更彈性。這些方法不需要重新訓練,也比較容易快速改規則。

另一個合理擔憂是,微調可能把資料噪音一併學進去。若標註標準不一致,模型會把錯誤當成模式,最後得到一個在離線測試看起來不錯、上線卻常常失手的系統。對某些團隊來說,與其急著微調,不如先把資料治理做好,否則只是把問題從 prompt 層搬到權重層。

但這些批評並沒有推翻微調,只是劃出它的邊界。我的立場很明確:當任務有穩定輸入、穩定輸出與明確評分標準時,微調仍然是最合理的預設方案。真正不該做的是把它當萬靈丹;如果需求本來就高度流動,那就先不要微調,這不是否定,而是選擇正確的工具。

你能做什麼

如果你是工程師,先建立一個可回歸測試的基準集,再決定要不要微調,別只靠主觀感覺判斷模型好不好。若你是 PM,要求團隊先定義成功指標與失敗案例,因為沒有標準答案的任務,根本不適合談微調。若你是創辦人,請把資料品質預算排在算力前面,因為模型效果通常不是被 GPU 限制,而是被標註與流程限制。

最實際的做法是:先用通用模型跑出 baseline,再用真實業務資料做誤差分析,找出錯誤集中在哪些類型,最後才決定是否微調。當你能清楚說出「模型在哪裡失敗、失敗有多常見、修正後能帶來多少收益」時,微調就不再是技術偏好,而是可證明的產品決策。