為什麼 AI Agent 時代,Prompt Engineering 已經死了

AI Agent 的關鍵不在於把提示詞寫得更漂亮,而在於把上下文選對、排好、壓縮好;context engineering 才是可靠性的核心。

AI Agent 的可靠性不靠更會寫提示詞,而靠上下文管理:選對資訊、控制長度、維持狀態。

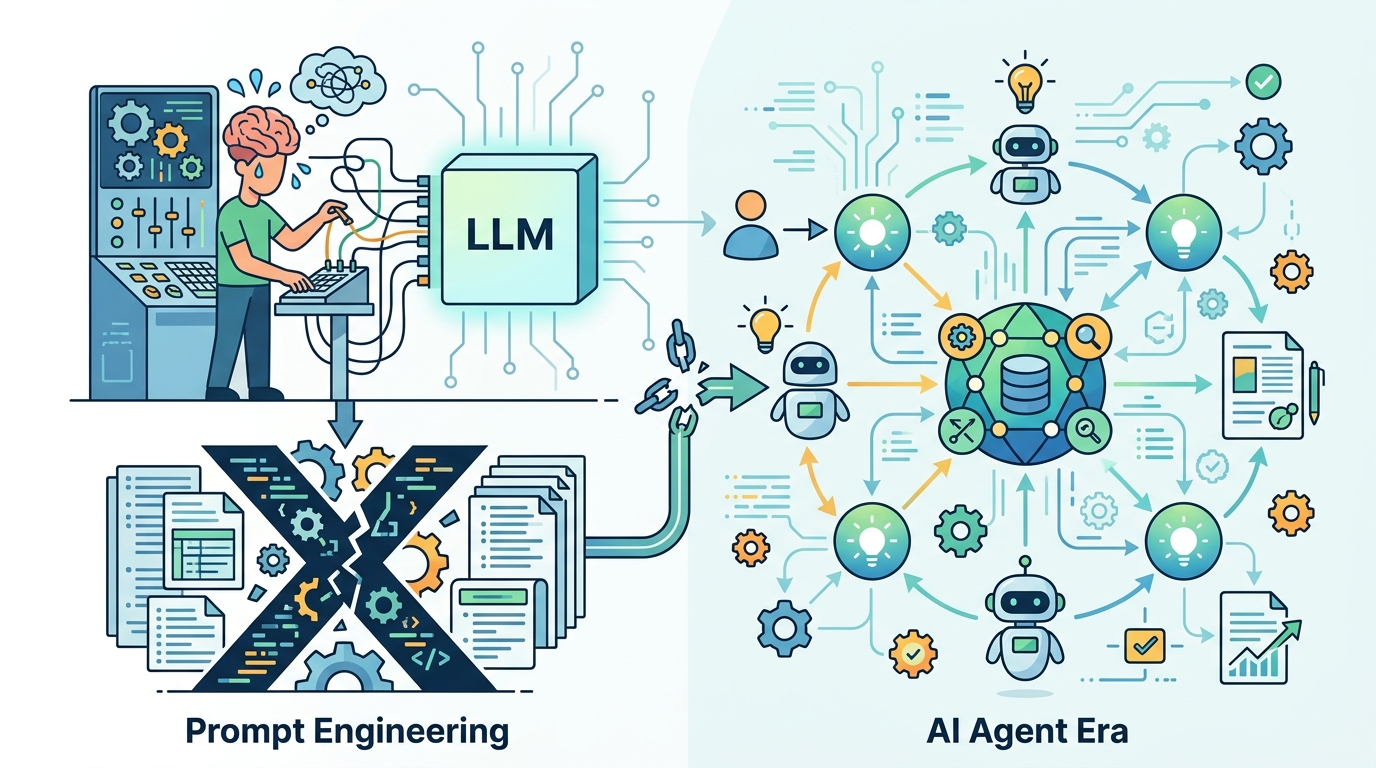

Prompt engineering 對 AI agents 來說已經不是主戰場,因為真正決定成敗的不是措辭,而是上下文管理。Chroma 在 2025 年 7 月針對 18 個模型的研究,包含 Claude 4、GPT-4.1 與 Gemini 2.5,顯示 context 一拉長,表現就下滑,而且連簡單的檢索任務都會受影響。這代表問題不是模型「突然變笨」,而是它在錯的時間看到太多錯的資訊。

第一個論點

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

對 AI agents 而言,prompt 只是包裝,真正的產品是整包上下文:指令、工具、記憶、檢索文件與任務狀態。只要這包內容雜亂,agent 就會失手,即使 prompt 寫得再工整也一樣。很多團隊把心力花在字句修飾,卻忽略了系統輸入本身才是主要變因。

Chroma 的結果之所以重要,是因為它說明退化不是線性的。context 變長不等於資訊變多、答案就更好;相反地,模型的注意力會被競爭中的 token 分散,連原本很簡單的 retrieval 任務也會變差。這不是文案問題,而是系統設計問題。

第二個論點

真正能交付穩定 agent 的團隊,不會只靠一段萬用指令。他們做的是管線:先選資料、再排序、再壓縮、再更新 context,最後才交給模型回應。這就是為什麼 context engineering 比 prompt engineering 更接近實戰:它把模型視為系統的最後一步,而不是整個系統本身。

以客服自動化為例,把完整工單歷史、產品文件、政策全文與前一次工具輸出一次塞進去,常常比不上只給它「當前問題、相關政策片段、上一輪動作摘要」的精簡版本。這裡的關鍵不是少,而是準。對 agent 來說,正確的 300 個 token,常常勝過錯置的 3,000 個 token。

反方可能怎麼說

prompt engineering 的支持者不是完全錯。對於範圍很窄的工作流,一段精準的 system prompt 確實能大幅改善行為;清楚的格式、明確的限制、挑對的 few-shot 範例,都有實際效果。很多今天上線的 production agent,仍然離不開這些基本功。

另一個合理顧慮是,context engineering 聽起來很對,但工程成本也很高。若每個 agent 都要加 retrieval、memory manager、summarizer 和 ranking service,團隊可能還沒做出產品,就先被基礎設施拖住。對小產品來說,強 prompt 仍然是最快的起步方式。

但這些都是限制,不是反駁。prompt quality 是必要條件,卻不是充分條件;一旦 agent 要跨多步驟、多工具、或多個真實資料來源行動,核心問題就會變成選擇與控制,而不是修辭。Chroma 的研究也把邊界講得很清楚:context 越長,表現越差,所以真正的解法是工程化 context window,而不是繼續堆字。

你能做什麼

如果你是工程師,別再把 prompt 當成主要抽象層,改做 context pipeline:少抓資料、提高排序品質、積極摘要、並且只保留當前步驟真的需要的記憶。如果你是 PM 或創辦人,請用真實 context 負載下的任務成功率評估 agent,不要只看 demo 好不好看。問題從來不是「提示詞寫得夠不夠聰明」,而是「agent 有沒有在正確的時間拿到正確的證據」。