Midjourney公測背後的視覺生成史

Midjourney 透過 Discord 公測走紅,也把圖像生成帶進社交式互動。這篇文章回顧從 GAN、DALL·E 2 到 Stable Diffusion 的技術脈絡,拆解它怎麼改寫視覺生成的傳播方式。

7 月,Midjourney 進入公測。它沒有先做傳統 App。它把入口放進 Discord。這招很狠。使用者不是對著空白畫布發呆,而是在公開頻道看別人一直生圖、改圖、再生圖。

這種做法讓圖像生成變成社交內容。也讓 Midjourney 的審美很快被記住。它不追求死板還原。它更像把「好看」直接寫進預設值裡。說真的,這東西蠻猛的。

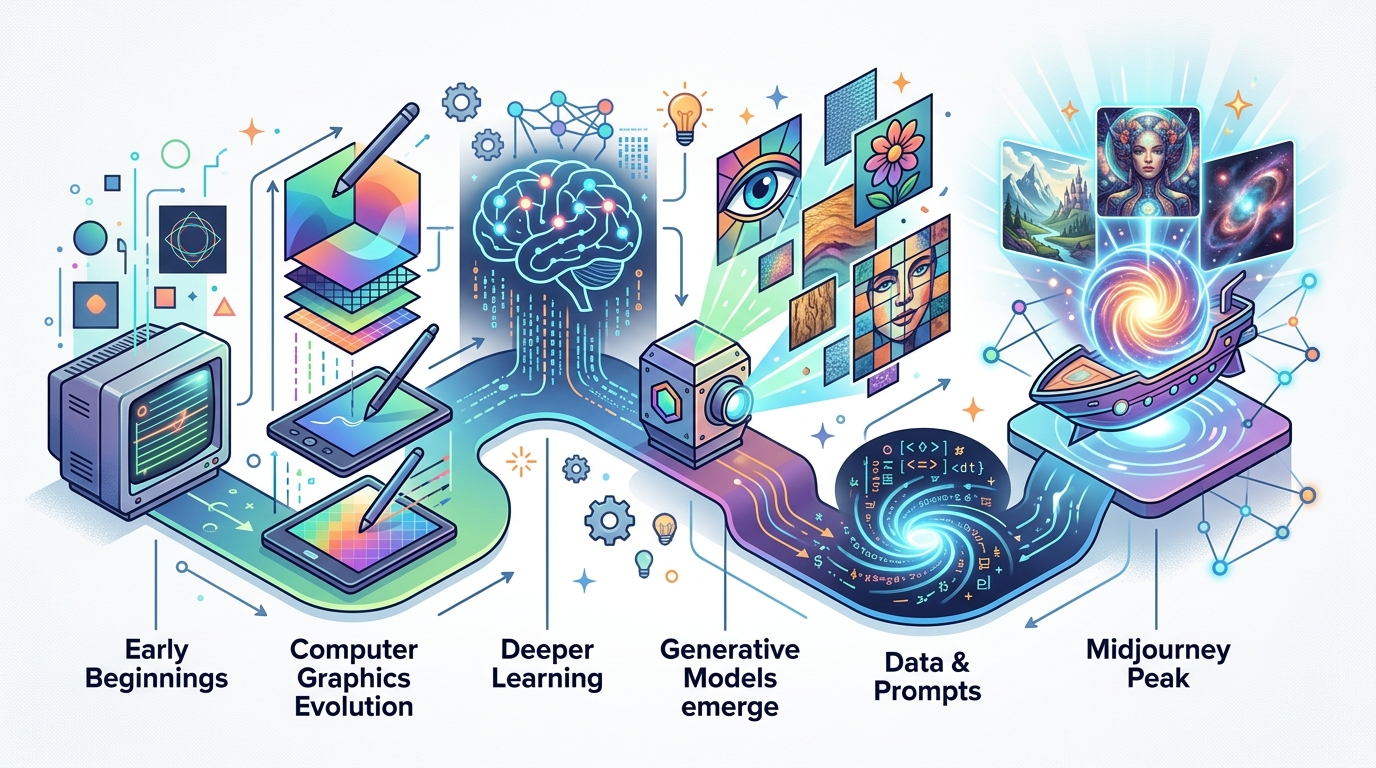

如果把視角拉遠,Midjourney 只是最新一段。從規則繪圖,到 GAN,再到擴散模型,視覺生成已經走了 70 多年。今天你按幾下就出圖,背後其實是好幾代研究和產品設計疊出來的結果。

Midjourney 為什麼先贏在 Discord

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

Midjourney 早期沒有把心力放在獨立客戶端。它直接選了 Discord。這讓使用門檻低很多。你不用先學一堆介面。你只要會打提示詞,就能開始玩。

更重要的是,生成過程本身變成內容。你發一句 prompt,幾秒後拿到四張圖。接著可以放大、做變體、重抽。整套流程很適合被圍觀。這種公開感,讓產品自己幫自己傳播。

它的審美策略也很明確。Midjourney 不太像照片修復工具。它比較像概念設計機。高對比、強光影、細節多、構圖滿。普通人一看就覺得「有料」。設計師也容易拿來當靈感底稿。

這種路線,跟很多只拼寫實度的工具不同。它不是只求像。它要的是可分享。這差很多。

- 入口在 Discord,學習成本低

- 生成過程公開,天然有傳播效果

- 結果偏藝術化,不只追求寫實

- V-series 後風格更穩,辨識度更高

從規則繪圖到擴散模型

視覺生成不是近幾年才冒出來。很早以前,研究者就想讓電腦自己畫圖。只是那時的方法比較像手寫規則。你指定線條、幾何、變形。電腦能做,但很難畫出有內容感的圖。

真正把這條路推進到實用層級的,是深度學習。2014 年,Ian Goodfellow 提出 GAN。那時生成圖像第一次有了更強的真實感。後來,擴散模型接手高品質生成任務。OpenAI 的 DALL·E 2、Stability AI 的 Stable Diffusion,把文字到圖像帶到更多人手上。

Midjourney 的差異,不是它發明了生成圖像。它是把模型輸出包成穩定的審美體驗。很多模型能生出「正確」的圖。Midjourney 更擅長生出「願意發出去」的圖。這就是產品層的差別。

“The future of AI is not about replacing humans, it’s about amplifying human creativity.” — David Holz

這句話很常被拿來講 Midjourney 的產品哲學。它沒有把自己包裝成設計師殺手。它更像在說,工具可以幫你更快做出畫面。重點是放大創意,不是取代人。

也因為這樣,它會先優化風格、構圖、整體觀感。不是先追求每個像素都像照片。這條路很務實,也很符合一般創作者的使用習慣。

四個節點看視覺生成怎麼演進

如果把視覺生成史壓成幾個節點,會清楚很多。每一代技術都在補前一代的洞。使用者感受到的,通常不是演算法名詞,而是結果夠不夠好用。

先看幾個數字。GAN 论文在 2014 年發表。DALL·E 2 在 2022 年把文字生成圖像推高一階。Stable Diffusion 同年開源後,迅速進入本地部署和第三方軟體。Midjourney 則用 Discord 先做社群,再做產品。

這條線很清楚。先有生成能力。再有大規模可用性。最後才是產品分發。很多團隊卡住的地方,不是模型不夠強,而是沒有把模型變成每天會打開的工具。

- 2014:GAN 讓生成圖像更像真的

- 2022:DALL·E 2 把文字轉圖像推到更高品質

- 2022:Stable Diffusion 開源後快速擴散

- Midjourney:把 Discord 社群當成產品入口

這也說明一件事。視覺生成的競爭,早就不只是誰的模型分數高。更重要的是,誰能把能力變成使用者每天都會碰到的工作流。這點 Midjourney 做得很早。

OpenAI 為何讓 Sora 先停在展示

這裡提到 Sora,不是在講圖片。是在講影片。OpenAI 公開展示 Sora 時,重點放在長時間一致性、複雜場景、鏡頭運動。外界第一次很直觀地看到,影片生成已經不只是短片 demo。

但影片比圖片難太多。圖片只要一瞬間成立。影片要在時間軸上都對。人物不能突然變臉。物體不能亂跳。光線和運動也要合理。這比生一張漂亮圖麻煩很多。

所以 Midjourney 和 Sora 的問題不同。Midjourney 處理的是靜態圖的審美穩定性。Sora 處理的是動態世界的邏輯一致性。前者回答「好不好看」。後者回答「會不會動,而且動得通」。

對產品來說,這也是一個分水嶺。生成式 AI 已經不是只比參數。現在比的是工作流。誰能讓創作者真的拿去用,誰才有機會變成日常工具。

誰會更吃香

接下來有競爭力的產品,不一定是最像真的那個。它可能是最適合某個場景的那個。Midjourney 證明了審美一致性和社群傳播很有用。Sora 則提醒大家,影片生成的門檻高很多。

對開發者和產品經理來說,判斷標準很現實。模型能力只是起點。入口設計、回饋速度、審美策略、版權邊界、工作流整合,全部都會影響結果。只丟 API 出來,通常不夠。

如果你想看下一波視覺生成產品誰會跑出來,可以盯這些點:

- 生成結果是否穩定,不是只看單次驚豔

- 是否容易分享,社群傳播效率高不高

- 能不能塞進設計、廣告、短影音和電商流程

- 對風格控制和版權風險處理得好不好

Midjourney 的故事很直接。生成式 AI 的勝負手,常常不在模型表格裡,而在第一眼看到的那張圖。下一階段,誰能把「好看、可控、可重複使用」一起做好,誰就更接近真正的工作入口。問題已經不是圖能不能生,而是誰會把生成結果變成標準流程。

背景其實比產品更早

很多人以為 AI 生圖是這幾年才冒出來。其實不是。早期的電腦圖學,重點在幾何、渲染、規則。那時候的工具很硬。你得知道怎麼描述形狀。它不是給一般人玩的。

後來深度學習改變了玩法。模型開始學資料分布。它不再只是照規則畫。它會從大量圖像裡學出風格、結構、物件關係。這讓「用語言描述畫面」變得可行。這一步很大。

台灣開發者如果看這條線,會發現一件很現實的事。真正值錢的,不一定是單一模型。常常是模型、介面、社群、資料流程一起配好。這也是為什麼很多工具明明模型不差,卻還是紅不起來。

下一波比的是工作流

我覺得接下來 12 到 24 個月,會更像工作流大戰。單純比誰圖漂亮,已經不夠了。大家會開始比誰能接進設計軟體、剪輯流程、廣告素材流程,甚至電商上架流程。

如果你是開發者,現在很適合盯三件事。第一,模型輸出是否穩。第二,介面是否夠快。第三,能不能把生成結果接到真實任務。這三件事,比單純追新模型更重要。

說白了,Midjourney 的成功不是只靠模型。它把生成圖這件事,做成一種人人看得懂的互動。這才是最值得學的地方。下一個跑出來的產品,可能不一定長得像 Midjourney,但一定會更懂怎麼讓人一直用下去。