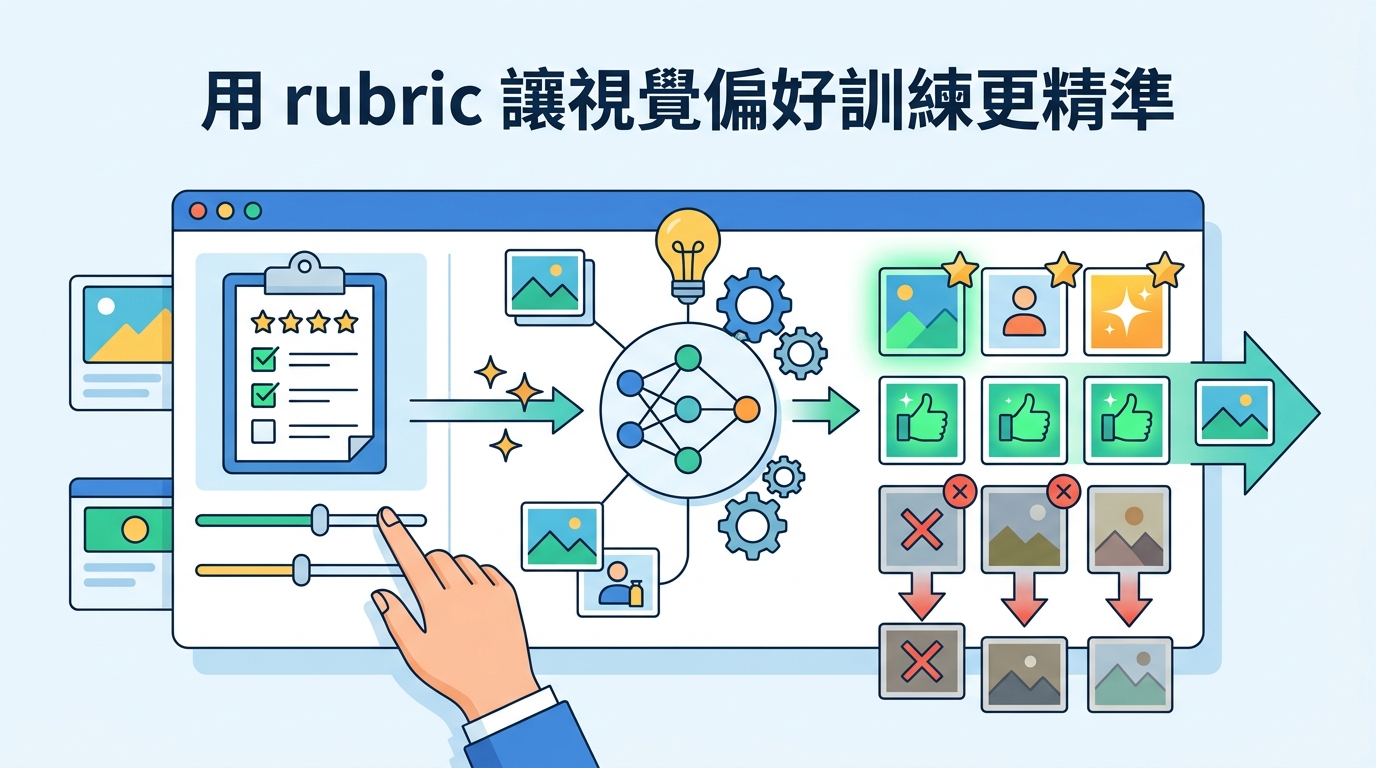

用 rubric 讓視覺偏好訓練更精準

rDPO 用每個圖文任務的專屬 rubric 取代粗粒度偏好訊號,讓視覺偏好最佳化更細緻,並在過濾與 benchmark 上帶來提升。

很多偏好最佳化流程,都默認一件事:只要 A 比 B 好,模型就能從這組 pair 學到東西。但這篇 arXiv 論文提醒我們,這個假設放到多模態任務時,常常太粗。論文提出 Visual Preference Optimization with Rubric Rewards,簡稱 rDPO,想把原本只看整體輸贏的訊號,改成更像 checklist 的、針對單一樣本設計的 rubric。

白話一點說,視覺任務的好壞,常常不是「整體感覺比較好」而已,而是有沒有看對物件、有沒有跟著指令做、以及有沒有處理好圖像裡那些很細的限制。若偏好資料沒有把這些差異寫清楚,最佳化器很可能學到錯的重點。rDPO 的出發點,就是讓偏好資料更貼近多模態系統真正需要的判準。

這篇論文想修正什麼問題

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

論文先從 DPO 的老問題切入:方法本身沒有魔法,關鍵還是背後的偏好資料。作者指出,在多模態場景裡,既有流程常依賴 off-policy 擾動,或是只看結果好壞的粗訊號。這種訊號拿來做大方向排序可以,但不太適合細粒度的視覺推理。

原因很直接。圖像任務很少只是產生一個「整體上更好」的回答。回覆可以很順,但還是漏掉關鍵視覺細節。若資料蒐集只記錄整體結果,模型就不一定知道,對某一張圖、某一條指令來說,到底是哪個標準在區分好壞。

所以這篇論文的核心主張是:如果任務本身是 instance-specific,那 reward 訊號也應該是 instance-specific。rDPO 不再只問「哪個答案比較好」,而是要求以 rubric-based evaluation 來拆解成 essential 與 additional criteria。

rDPO 到底怎麼運作

rDPO 的做法,是為每個 image-instruction pair 建一份 checklist 式 rubric。這份 rubric 會列出評分所需的 criteria,而且是可以拿來評估任何 policy 的輸出,不會綁死在某個模型的語氣或輸出風格上。換句話說,rubric 描述的是這個例子真正重要的事,而不是某個模型看起來「比較像樣」的表達方式。

論文還提到,instruction-rubric pool 是在離線階段先建立,再拿去重用於 on-policy data 的建構。這點很重要,因為它不是每次訓練步都重新做一次標註,而是先把可重用的 criteria 做好,之後再拿來配合目前 policy 產生的資料。

從工程角度看,這等於把兩個常被拆開的流程接起來:一個是資料生成,一個是 reward 評估。on-policy 的好處,是資料更接近模型當下的行為;rubric 的好處,是把 feedback 拉回到更精準的 criterion-level,而不是只給一個 win/loss 標籤。

論文把這種設計視為更適合 visual preference optimization 的方式,因為 feedback 同時具備兩個特性:一是 local,因為它綁定特定的圖文樣本;二是 structured,因為它不是單一總分,而是由 essential 與 additional criteria 組成。

論文實際證明了什麼

這篇摘要給了三類結果:reward modeling benchmarks、downstream benchmarks,以及一個綜合性的 scalability benchmark。和很多只有概念沒有數字的摘要相比,這篇至少有一些可比較的數值。

在 public reward modeling benchmarks 上,rubric-based prompting 對一個 30B-A3B judge 有「大幅」提升,並且把表現拉到接近 GPT-5.4。摘要沒有提供這個比較的完整分數,所以只能依照作者的文字判斷提升幅度很明顯,但無法從摘要精確算出差距。

在 public downstream benchmarks 上,rubric-based filtering 讓 macro average 提升到 82.69。相對地,outcome-based filtering 會從 81.14 掉到 75.82。這一組數字很關鍵,因為它直接顯示:在作者的設定裡,單純看結果的過濾方式,不只不夠細,還可能把表現拉低;改成 rubric 之後,效果明顯更好。

第三個結果是 scalability benchmark。rDPO 在一個 comprehensive benchmark 上拿到 61.01,優於 style-constrained baseline 的 52.36,也超過 59.48 的 base model。摘要沒有在這裡寫出 benchmark 名稱,所以最安全的解讀是:在該評測上,rDPO 的擴展性與整體表現都比 baseline 更好,甚至超過起始模型。

但也要注意,摘要沒有提供訓練成本、延遲、標註吞吐量,或是 rubric 建置的實際難度。也就是說,這篇論文證明了方法「可能有效」,但還沒在摘要裡回答「要付出多少代價」。

對開發者有什麼影響

如果你在做 multimodal assistant、vision-language evaluator,或任何依賴 preference tuning 的系統,這篇論文其實在提醒一個常見失誤:太通用的偏好標籤,對圖像推理來說可能太粗。模型可能會學著產出看起來更好的回答,卻還是漏掉真正重要的視覺條件。

rDPO 提供的方向很工程化:把 reward signal 做得更明確,而且要跟任務本身綁緊。這不只對訓練 policy 有用,對做 judge model 也有參考價值。摘要提到 rubric-based prompting 讓 30B-A3B judge 的表現大幅改善,這暗示它可能不只是 policy optimization 的技巧,也可能是評估品質的補強手段。

另外,這篇論文也透露一個資料工程上的想法:先離線建立 instruction-rubric pool,再重複使用。這代表 rubric 不是每筆資料都重做一次,而是有機會攤提成本。對想把標註流程做規模化的團隊來說,這可能是最實用的部分。

限制與還沒說清楚的地方

摘要對結果講得不少,但對實作細節講得很少,所以還有幾個問題沒被回答。rubric 的建立成本,會不會比一般 preference labeling 高很多?不同標註者或自動 judge 對 rubric 的一致性如何?提升到底有多少來自更好的資料選擇,又有多少是 rubric 結構本身的功勞?

還有一個更大的問題是可移植性。論文強調 rubrics 是 instance-specific,這正是它的優點,但也意味著它可能比較難直接套到差異很大的領域。若指令與圖像內容變化很大,團隊就需要一套夠穩的 rubric 生成流程,否則規模化會變得麻煩。

另外,摘要沒有列出所有 benchmark 的名稱,也沒有附上完整 ablation。換句話說,雖然方向很清楚:on-policy data 加上 criterion-level feedback,通常比粗粒度 outcome filtering 更好;但真正的適用邊界,還得看完整論文才能判斷。

總結來說,這篇論文的重點很直接:如果你的多模態偏好資料太模糊,最佳化器學到的東西也會太模糊。rDPO 想做的事,就是把視覺偏好學習變成 rubric-driven process,而摘要裡的數字顯示,這種額外結構確實有機會帶來實際收益。

- 核心想法:用 instance-specific rubric 取代粗粒度偏好標籤。

- 訓練設計:先離線建立 instruction-rubric pool,再重用到 on-policy data 建構。

- 已公開結果:reward modeling、downstream macro average、scalability benchmark 都有提升。

- 主要限制:摘要沒有交代 rubric 成本、完整 benchmark 名稱與完整 ablation。

對實作端來說,這篇的價值不只在分數。它提供的是一個設計模式:如果你的任務依賴細微的視覺判準,就先把判準寫清楚,再讓模型去優化。