GLM-5V-Turbo 在 Design2Code 贏了…

Z.ai 的 GLM-5V-Turbo 在 Design2Code 拿下 94.8,壓過 Claude Opus 4.6 的 77.3。它還用 Huawei Ascend 完成訓練,主打視覺轉程式與 GUI agent 工作流。

Z.ai 這次丟出一個很直接的數字:94.8。這是 Design2Code 上,GLM-5V-Turbo 拿到的分數。對比 Claude Opus 4.6 的 77.3,差距很明顯。說白了,這不是聊天能力比賽,這是看誰比較會把畫面變成程式。

更有意思的是,它不是靠 NVIDIA 堆出來的。Z.ai 說,這個模型是用 Huawei Ascend 晶片訓練,搭配 MindSpore,整條訓練鏈都沒碰 NVIDIA。這件事對硬體供應鏈、成本結構、還有中國 AI 生態,都很有意思。

如果你在做 UI agent、screenshot-to-code、或設計稿自動轉前端,這個模型就不是新聞稿而已。它是在直接碰你的工作流程。這種東西,開發者通常會先懷疑,再偷偷拿去測。

這顆模型到底在做什麼

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

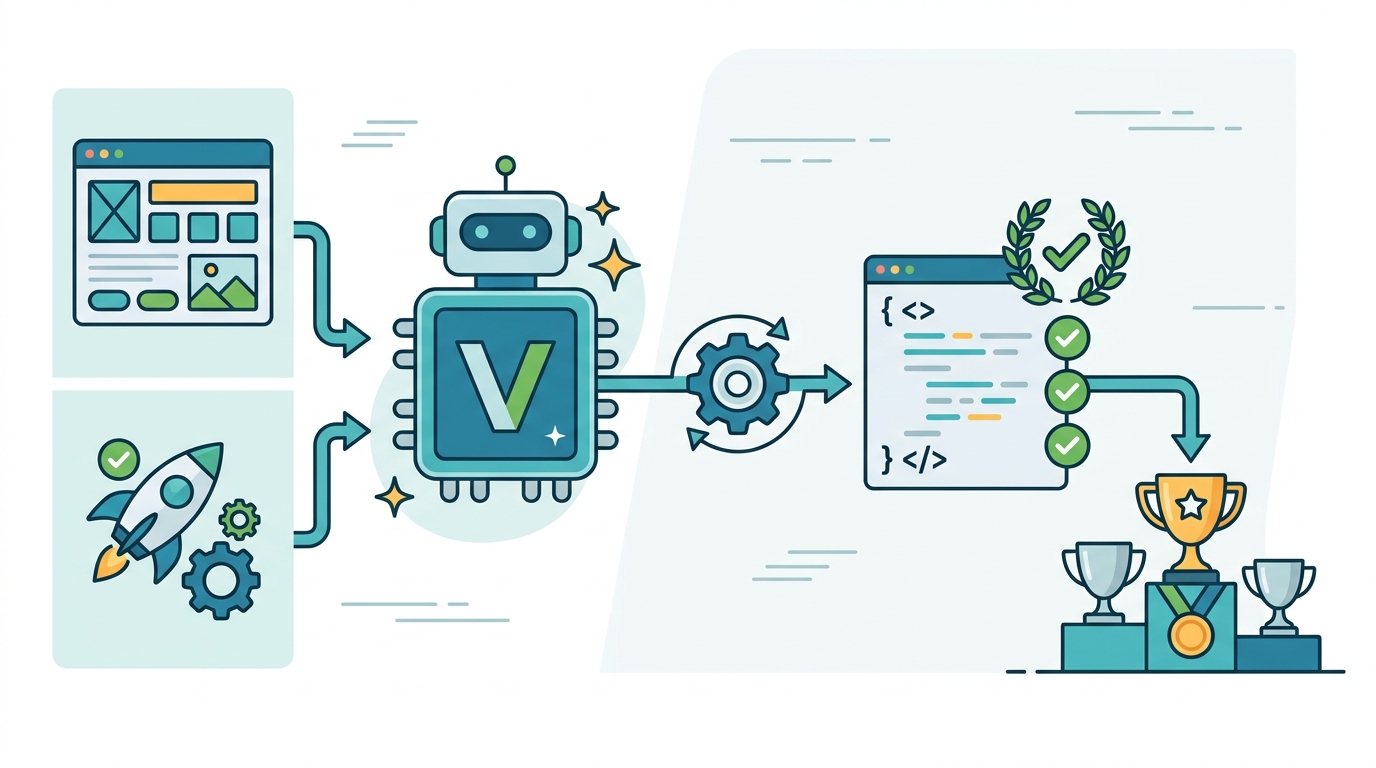

GLM-5V-Turbo 不是那種「先做聊天,再補上圖片」的模型。它從一開始就瞄準視覺理解、介面操作、和程式生成。你丟給它截圖、設計稿、文件版面、圖片,甚至影片畫面,它會試著把這些視覺資訊轉成程式碼,或直接變成操作動作。

它屬於 GLM-5 家族。官方說法是 7450 億參數、256 個 experts、每次推理大約啟用 440 億參數。這種 Mixture of Experts 架構,重點不是把全部參數都燒起來,而是讓模型在不同任務上切不同子網路。講白了,就是更會分工。

視覺部分則加上 CogViT。這是新的 vision encoder。它的價值在於,模型不是把圖片當成附加檔案,而是直接吃進視覺訊號。這差很多。前者常常像貼圖,後者才像真的看懂。

- Design2Code 分數:94.8

- Claude Opus 4.6:77.3

- 模型家族:GLM-5

- 總參數:約 7450 億

- Experts:256

- 每次推理啟用:約 440 億參數

- Context window:20 萬 tokens

- 輸出上限:12.8 萬 tokens

為什麼這個分數很重要

Design2Code 這種測試,比一般聊天排行榜更有意義。它不是問模型會不會講道理,而是問它能不能把設計圖真的做出來。你給它一張 Figma mockup,或一張產品截圖,它要能吐出可用的 HTML、CSS、甚至元件結構。這很貼近真實開發。

對很多團隊來說,這才是 AI 最值錢的地方。不是幫你寫一段漂亮文案,而是把設計、前端、和自動化串起來。94.8 代表什麼?代表它在這條路上,至少在這個 benchmark 上,比 Claude Opus 4.6 更像一個會做事的工具。

Z.ai 也說,GLM-5V-Turbo 在 AndroidWorld 和 WebVoyager 這類 GUI agent 環境也有不錯表現。這類測試很煩,但很真實。模型不是只要會答題,而是要會在軟體介面裡走路、點按鈕、找欄位、處理錯誤。

“The future of AI will be about systems that can act, not just answer.” — Satya Nadella

這句話是 Satya Nadella 說的。放在這裡很貼切。現在很多產品都在往 agent 走。不是只有回你一段文字,而是直接幫你跑流程。GLM-5V-Turbo 就是朝這個方向下手。

但先別急著說它把 Claude 打趴了。Z.ai 自己的說法也暗示,Claude 在純文字 coding、後端推理、repo 探索,可能還是更穩。這比較像分工,不是通殺。視覺轉程式這條線,它很強。純文字重度推理,未必。

價格跟硬體,才是另一個重點

Z.ai 的定價很殺。API 標價是每百萬 input tokens 1.20 美元,output tokens 4.00 美元,cached reads 0.24 美元。這不是小差距。對要跑 agent loop 的團隊來說,這種差距會直接反映在月帳單上。

為什麼?因為 GUI agent 很燒 token。它要看畫面、想下一步、叫工具、再修正輸出。一次任務常常不是一個 prompt 就結束,而是十幾輪來回。這時候,便宜 60% 到 80% 的模型,就會變成很實際的選項。

OpenRouter 的早期數據也有參考價值。據平台統計,這個模型上線前兩天大約有 5.9 萬次請求,63.6 百萬 reasoning tokens,還有 18,900 次 tool function calls。這不像只是大家試玩一下。比較像開發者真的在拿它做事。

- Input 價格:每百萬 tokens 1.20 美元

- Output 價格:每百萬 tokens 4.00 美元

- Cached reads:每百萬 tokens 0.24 美元

- OpenRouter 兩天請求量:約 59,000

- Reasoning tokens:6,360 萬

- Tool function calls:18,900

硬體這件事也不能跳過。用 Ascend 訓練,代表 Z.ai 可以少碰一些 NVIDIA 供應風險。對中國公司來說,這不是口號,是實際的採購和部署問題。能不能訓練、能不能擴容、能不能穩定跑,全部都跟硬體綁在一起。

如果它真的能在 Ascend 上把模型品質維持住,那就很有看頭。因為這代表 AI 訓練不再只剩一條路。對生態系來說,這種選擇會影響成本,也會影響供應鏈談判力。

跟 Claude、其他模型比,差在哪

先講白一點,這不是「所有任務都贏」的故事。GLM-5V-Turbo 的強項很明確,就是視覺輸入轉程式、GUI 操作、和設計稿重建。Claude 的優勢則比較像文字推理、長文理解、程式碼審查、還有比較成熟的通用對話能力。

如果你把兩者放進同一個工作流,結果可能是分工。GLM-5V-Turbo 負責看畫面、拉結構、產出前端骨架。Claude 負責讀 repo、看 API、補商業邏輯、檢查 edge cases。這種組合,比硬要選一個更合理。

從數據上看,94.8 對 77.3 的差距很大,但要注意 benchmark 屬性。Design2Code 本來就偏向視覺還原與結構生成。它很適合測這類模型,但不代表它能完整代表所有 coding 場景。這點很多人會偷懶忽略,我覺得不行。

- Design2Code:GLM-5V-Turbo 94.8,Claude Opus 4.6 77.3

- 定位差異:前者偏視覺轉程式,後者偏通用推理

- 適合場景:Figma、截圖、網頁重建、GUI agent

- 較穩場景:後端推理、長 repo 分析、文字密集任務

- 成本面:Z.ai 定價明顯更低

如果你是產品團隊,這個差異很現實。你不會拿一個最強聊天模型,硬去做所有介面自動化。那樣太貴,也太浪費。你會想找一個更便宜、而且在特定任務上更準的模型。GLM-5V-Turbo 看起來就是衝這個位置。

老實說,這種產品策略比「我們什麼都最強」更可信。因為 AI 現在就是分工時代。沒有人有空等一個萬能模型。大家要的是能直接上線的工具。

中國 AI 硬體路線,現在更清楚了

GLM-5V-Turbo 的訓練方式,放大看很有代表性。它不是單純一個模型發布,而是把中國 AI 生態裡幾個元素串起來:自家模型、國產晶片、國產訓練框架。這條路線,跟美系雲端和 NVIDIA 堆疊的主流打法,差很多。

這也反映出一個現實。AI 模型不只是演算法競賽。它同時是供應鏈競賽、算力競賽、還有部署成本競賽。誰能在限制較多的環境裡,把模型訓練和推理都跑順,誰就有更多商業空間。

Z.ai 今年 1 月完成香港 IPO,募得約 5.58 億美元。這筆錢不只是拿來講故事。它可以燒在訓練、推理基礎設施、還有產品落地。對一家還在擴張的公司來說,這種資金彈性很重要。

放到產業脈絡看,這也代表一件事:未來的 AI 競爭,不會只看「誰的模型分數高」。還要看誰能在特定硬體、特定法規、特定成本條件下,把產品做出來。這才是能活下去的路。

接下來,開發者該看什麼

我覺得最值得觀察的,不是單次 benchmark,而是它能不能變成日常工具。你可以先問自己一個很實際的問題:你的工作起點是什麼?如果是截圖、Figma、瀏覽器畫面、或文件版面,那 GLM-5V-Turbo 很值得試。

如果你的工作主要是後端邏輯、程式碼重構、或大型 repo 分析,那你可能還是會偏向 Claude,或其他更擅長文字推理的模型。這很正常。工具就是工具,不需要神化。

接下來幾個月,我會盯兩件事。第一,它在真實產品裡的錯誤率。第二,社群會不會把它接進現有的 UI agent 工具鏈。只要這兩件事做得起來,這顆模型就不只是 benchmark 贏家,而是會被放進 production 的選項。

說真的,現在最該做的不是喊口號,而是找一個你手上的 design-to-code 任務,直接丟去測。看它能不能少改 30% 的前端草稿。這種數字,比任何形容詞都實在。