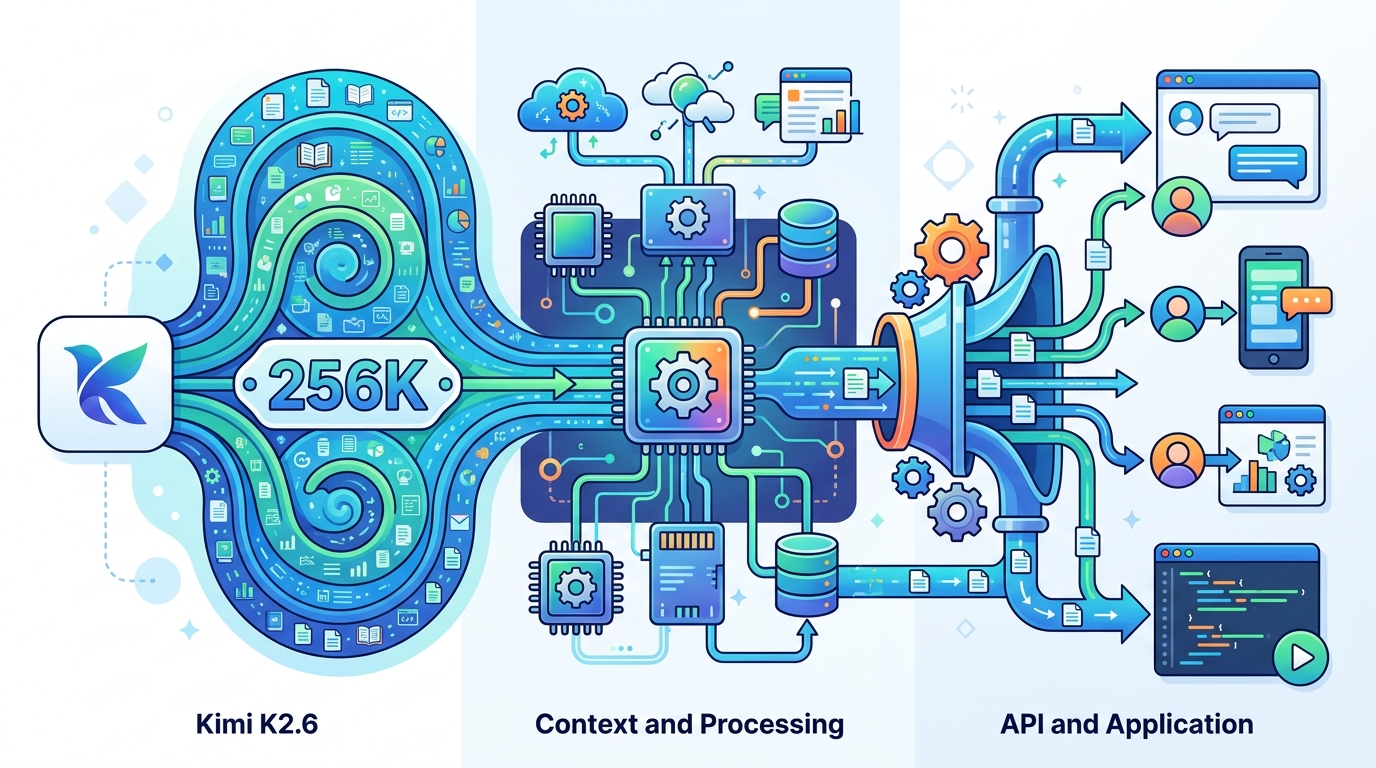

Kimi K2.6 把 256K 上下文帶進 API

Kimi K2.6 為 API 開發者帶來 256K 上下文、圖像與影片輸入,還強化長程式碼任務的穩定度。

Kimi K2.6 是給 API 開發者用的模型,主打 256K 上下文、圖像與影片輸入,還有更穩的長程式碼處理。

Kimi K2.6 這次很直接。它不是只想當聊天機器人。它要處理更長的程式碼庫,也要吃進文字、圖片、影片。

官方文件寫得很清楚。它保留 256K context window。它也強調長上下文下的 coding 穩定度。說真的,這種東西比花俏 demo 更像真實產品會需要的能力。

| 項目 | Kimi K2.6 提供什麼 | 對開發者的意義 |

|---|---|---|

| Context window | 256K tokens | 可塞更長對話、程式碼庫、文件 |

| 模型入口 | Kimi API Platform | 適合直接接進應用程式與 agent |

| SDK 相容性 | OpenAI API format | 可沿用熟悉的 client code |

| 多模態 | Text、image、video | 適合客服、文件審查、媒體分析 |

| 模型名稱 | kimi-k2.6 | 實際 request 要用的 identifier |

Kimi K2.6 想解決什麼問題

訂閱 AI 趨勢週報

每週精選模型發布、工具應用與深度分析,直送信箱。不定期,不騷擾。

不會寄垃圾信,隨時可取消。

這次的重點,是長程任務。像是多檔案改 code、連續多輪修 bug、還有工具呼叫後的回寫。這些場景最怕模型忘記前文,然後開始亂猜。

官方文件提到,它在 Rust、Go、Python 這些語言上更穩。也提到 frontend、DevOps、效能調校這類任務。這不是玩具級範例。這是很實際的軟體工作。

很多 coding model 在短 prompt 表現很好。可是一拉長,就開始掉線。講白了就是,會寫一段,不代表會做一個專案。

- 256K context 可用在 kimi-k2.6、kimi-k2.5 與多個 preview 版本。

- 文件強調 instruction compliance 與 self-correction。

- K2.6 同時支援 thinking 與 non-thinking 模式。

- agent 任務是設計核心,不是附加功能。

這組搭配很重要。你做 coding assistant 或內部自動化工具時,最怕模型只會第一句。你要的是能規劃、能叫工具、能看結果、還能重試的模型。

我覺得這才是 K2.6 的賣點。不是「會聊天」,而是「能把事情做完」。

多模態 API 怎麼改變接法

Kimi K2.6 不是純文字模型。它可以吃圖片,也可以吃影片。這讓它在客服、QA 審查、文件理解、媒體分析上更好用。

快速上手文件也很務實。它示範的是 OpenAI 風格的呼叫方式。你可以用 OpenAI Python SDK,接到 Moonshot endpoint。對很多團隊來說,這比重新學一套 API 友善太多。

如果你原本就有 OpenAI-style client code,切換模型就比較像換設定檔,不像重寫一個服務。這種低遷移成本,對產品團隊很現實。

“Kimi API is fully compatible with OpenAI’s API format.”

這句話很直白。它在告訴你,Kimi 想降低導入門檻。模型可以換,但整個開發流程不要大改。

官方文件列出的多模態支援也很完整。

- 圖片支援 png、jpeg、webp、gif

- 影片支援 mp4、mpeg、mov、avi、x-flv、mpg、webm、wmv、3gpp

- 支援 tool calling,適合 agent loop

- 支援 thinking mode 控制

這代表同一條 request path,可以同時處理截圖、文字說明、再輸出下一步動作。對客服 bot、內部 ops 工具、產品分析助理都很實用。

256K context 在實戰裡有多重要

長上下文這件事,平常看起來很抽象。真的碰到多檔案專案,你就知道它的價值。256K window 代表模型有更多空間記住前文、工具輸出、文件內容,還有更長的指令。

官方文件也寫到,256K window 不只給 K2.6。像 kimi-k2-0905-preview、kimi-k2-turbo-preview、kimi-k2-thinking、kimi-k2-thinking-turbo 也有相同等級的上下文配置。這表示它比較像平台能力,不是單一版本的噱頭。

如果你在做 agent,這個差異會很有感。因為 agent 常常會跑很多輪。每一輪都會吃 token。上下文不夠,模型就會開始失憶。

- 256K context 很適合多檔案 coding session。

- 也適合長篇研究與文件問答。

- 媒體請求的費用是動態計算。

- Kimi 提供 token estimation API 先估算用量。

最後那點很實際。圖片和影片一多,費用很容易爆。先估 token,再送 request,能少掉不少驚嚇。

文件還提到建議解析度與上傳方式。這表示它不是只想讓你玩玩看。它是照著 production workflow 在寫。

和其他模型比,差在哪裡

真正該比的,不是跟一般聊天機器人比。要比的是你現在已經在用的 coding model。Kimi 的策略很清楚:大上下文、OpenAI 相容、多模態,一次把幾個常見需求包起來。

如果你要評估它,問題很實際。它能不能在長 session 裡保持 code edits 一致。它遇到壞掉的 tool output,能不能自己修正。它看圖片和影片,表現有沒有好到可以少接一個模型。

這些都比 benchmark 數字更接近真實產品。因為產品上線後,不會有人在乎你跑了幾次 demo。大家只在乎它會不會出錯。

- OpenAI 風格整合,切換成本低。

- Kimi K2.6 直接支援多模態輸入。

- 256K window 對長 agent loop 很有幫助。

- 官方強調 self-correction,這通常比漂亮 demo 更重要。

如果你已經在做 agentic workflow,這組合就很值得試。你可以沿用 SDK 寫法,再看看長上下文到底有沒有改善輸出品質。

我會把它看成一個「少接幾個零件」的選項。不是每個團隊都需要,但需要的人會很在意。

這背後的產業脈絡

現在的 API 模型競爭,早就不是誰會聊天而已。大家都在比 context、tool use、multimodal、以及整合成本。因為真正花錢的地方,是工程時間,不是 demo 畫面。

Kimi 這次的路線很清楚。它想讓開發者少改程式。你可以用熟悉的 API 形式,把長上下文和多模態能力接進去。對台灣團隊來說,這種做法很務實。

另一個背景是 agent 工具鏈正在變複雜。你可能要接文件、截圖、影片、資料庫,還要讓模型自己循環呼叫工具。這時候,模型能不能記住前文,就變成核心問題。

這也是為什麼 256K 不是單純的規格數字。它直接影響你能不能少切 prompt、少拆流程、少寫 glue code。

結論:先拿你的工作流來測

Kimi K2.6 最適合的,不是短問短答場景。它比較像給工程團隊用的工作馬。長程式碼、長文件、多模態、agent loop,這些才是它的主場。

如果你手上已經有 OpenAI-compatible 的 client,我會建議直接換 endpoint 試一次。拿一個 20 檔以上的專案,或一段需要圖片輔助的客服流程,實測它會不會記錯前文。這比看規格表更準。

我自己的判斷很簡單:如果你的產品常常要處理長資料,K2.6 值得排進測試清單。反過來說,如果你的需求只是短 prompt 回答,那它的優勢就沒那麼明顯。