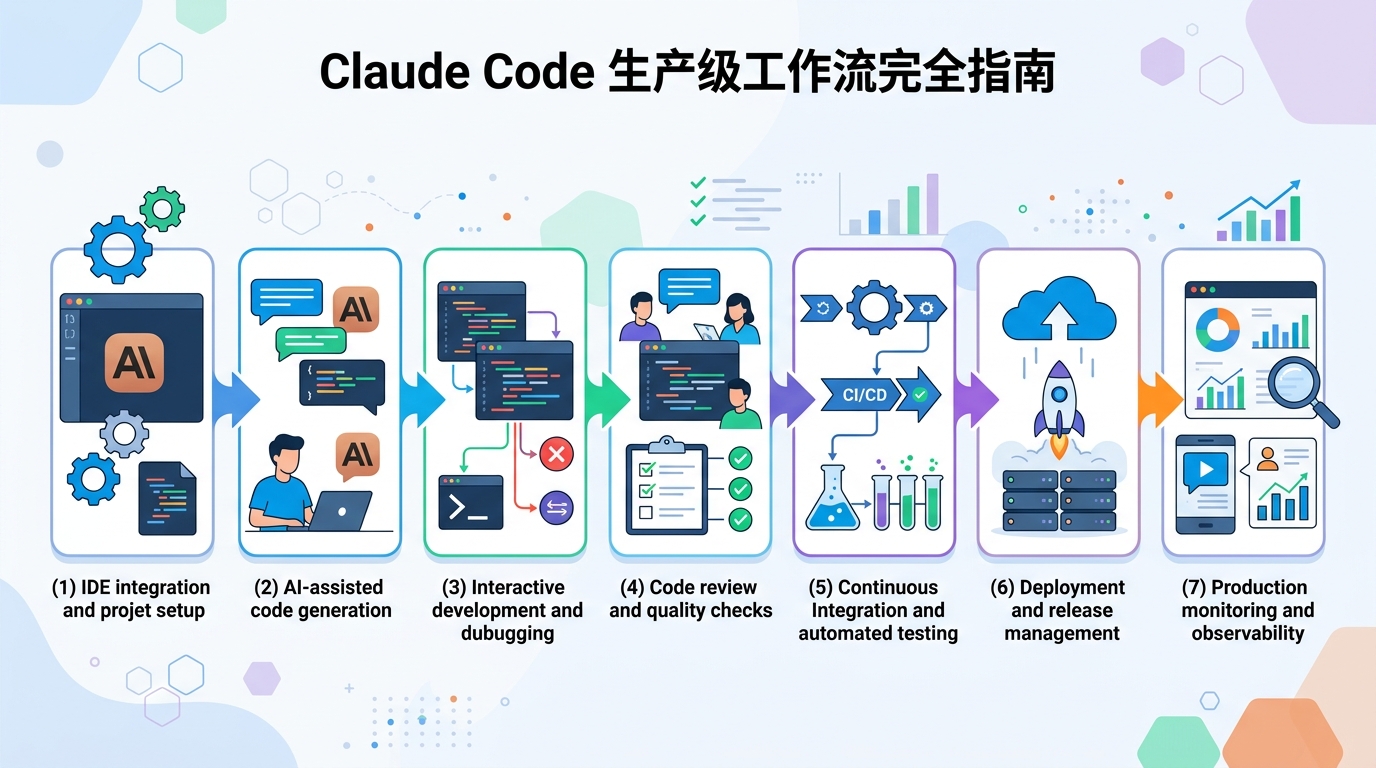

Claude Code 生产级工作流完全指南

Anthropic 限制中国大陆直连后,开发者更常用国产 Claude 兼容接口来跑 Claude Code。

Claude Code 在中国大陆更常通过兼容接口接入,而不是直连 Anthropic。

这篇文章最值得注意的地方,不是工具本身,而是它的使用前提已经变了:Anthropic 对中国大陆公司和个人限制了直接的 Claude API 访问。对很多开发者来说,这意味着 Claude Code 仍然能用,但接入方式、成本结构和稳定性都要重新算一遍。

如果你在国内做日常开发、代码审查、脚本生成或自动化改造,最现实的选择往往不是“想办法直连”,而是直接用国产模型提供的 Claude 兼容接口,把工具链先跑起来,再根据任务类型决定是否切回原生端点。

| 项目 | 信息 | 对开发者的影响 |

|---|---|---|

| 服务限制 | Anthropic 限制中国大陆公司及个人直连 Claude API | 接入方式要改 |

| 核心工具 | Claude Code | 仍可作为代码工作流入口 |

| 替代方案 | 国产 Claude 兼容接口 | 网络可达性更好 |

为什么这件事对开发者很现实

Get the latest AI news in your inbox

Weekly picks of model releases, tools, and deep dives — no spam, unsubscribe anytime.

No spam. Unsubscribe at any time.

很多 AI 编程工具的讨论都停留在“能不能写代码”,但真正落到团队里,第一关是“能不能稳定跑”。如果一个工具需要频繁处理网络、鉴权、地区访问和账单问题,它的实际价值就会被迅速稀释。

Claude Code 之所以被很多开发者关注,是因为它适合放进真实工作流:读仓库、改文件、生成补丁、做局部重构、补测试、解释复杂逻辑。问题在于,工具好用不等于接入简单,尤其当官方服务对部分地区不可用时,工作流设计本身就要先过一遍现实检验。

对国内用户来说,这篇内容的核心不是“如何追新”,而是“如何少踩坑”。如果你的目标是稳定产出,那就要优先考虑可达性、延迟、配额、价格和模型兼容度,而不是只看名字。

- 直连官方 API:适合可访问地区和合规场景

- 国产兼容接口:更适合国内日常开发环境

- 工作流优先级:稳定性通常比单次效果更重要

- 成本控制:长期使用时比“模型名气”更重要

Claude Code 到底适合做什么

Claude Code 不是一个纯聊天产品,它更接近“会读代码的执行型助手”。当你给它一个仓库、一个错误日志,或者一段复杂的业务逻辑,它可以直接参与到开发动作里,而不是只给你建议。

这类工具最适合的场景通常有四类:修复小而明确的 bug、生成或补全测试、重构局部模块、解释陌生代码路径。它不适合那种边界很模糊、需求一直变、还需要大量产品判断的任务,因为这类任务本来就不是单轮代码助手能稳定解决的。

如果你把它当成“自动写完整项目”的工具,失望概率会很高。把它当成“能读仓库、能改局部、能帮你节省重复劳动”的工具,体验会现实得多。

“Claude Code is the best coding assistant I’ve used for understanding and editing large codebases.” — Simon Willison, Simon Willison

这句话之所以有分量,是因为它来自长期写技术观察的独立开发者,而不是营销文案。Simon Willison 的判断也和很多实际使用者的感受一致:Claude Code 的强项不只是生成代码,而是处理上下文、理解仓库结构和做有约束的修改。

国内开发者该怎么选接入方式

从工程角度看,接入方式大致分成两条路:一条是直接使用 Anthropic 官方端点,另一条是使用兼容接口。前者适合能稳定访问官方服务的团队,后者更贴近国内大多数个人开发者和中小团队的现实环境。

兼容接口的价值不只是“能连上”,还包括在供应商切换、账单管理和团队协作上的灵活性。很多国产平台已经提供了 Claude 风格的 API 入口,开发者可以把它接到现有的脚本、IDE 插件或代理层里,先把自动化流程跑通。

选择时,别只看“是不是 Claude”。更值得比较的是限流策略、上下文长度、价格、响应延迟和是否支持流式输出。一个表面上更便宜的接口,如果经常超时或返回不稳定,最后的总成本往往更高。

- 可达性:是否稳定访问,是否需要额外网络处理

- 价格:按 token 计费还是按套餐计费

- 兼容度:是否支持现有 Claude Code 工作流

- 延迟:交互式编辑时体验差别很明显

如果你团队里已经有现成的 CI、代码审查和脚本自动化流程,最好的做法通常不是推倒重来,而是把模型接入层单独抽出来。这样一来,今天用 Claude 兼容接口,明天换别的模型,也不会把整套流程改坏。

和其他 AI 编程工具相比,差别在哪里

Claude Code 的竞争对手很多,但真正拉开差距的不是“谁会写代码”,而是谁更适合进入既有工程系统。对比 ChatGPT、GitHub Copilot 和 Cursor,Claude Code 的位置更像是“有上下文意识的仓库助手”。

它和 Copilot 的差别在于,Copilot 更像编辑器里的补全层,而 Claude Code 更像能主动阅读项目、再给出修改方案的执行者。它和 Cursor 的差别在于,Cursor 更偏 IDE 体验,而 Claude Code 更适合把任务拆成命令式步骤,接进终端和脚本流。

如果你关心的是“谁最适合大仓库”“谁更适合局部重构”“谁更适合做自动测试”,答案往往不是同一个。不同工具的定位差异,决定了它们在真实项目里的效率上限。

- GitHub Copilot:更偏补全和编辑器内体验

- Cursor:更偏 AI 原生 IDE

- ChatGPT:更适合对话式分析和解释

- Claude:在长上下文和代码理解上口碑很强

如果你做的是后端服务、基础设施脚本或内部工具,Claude Code 这类“能直接动仓库”的工具通常比纯聊天产品更省时间。要是你只是偶尔问几句代码问题,那它的优势就没那么明显。

结论:先解决接入,再谈效率

Claude Code 这类工具真正的门槛,已经从“会不会用”变成“能不能稳定接入”。对中国大陆开发者来说,最务实的路径是先选一个可达的 Claude 兼容接口,把仓库级工作流跑起来,再根据效果决定是否保留、切换或并行使用。

接下来最值得做的,不是继续围观模型名气,而是把你自己的开发链路拆开检查:哪一步最耗时,哪一步最适合交给模型,哪一步必须人工确认。只要这三件事想清楚,Claude Code 才会变成生产力工具,而不是又一个试用两天就放弃的 AI 应用。

真正的问题也很简单:你的团队现在是缺一个更聪明的模型,还是缺一个更稳定的接入方案?

// Related Articles

- [TOOLS]

Why VidHub 会员互通不是“买一次全设备通用”

- [TOOLS]

Why Bun’s Zig-to-Rust experiment is the right move

- [TOOLS]

Why OpenAI API pricing is a product strategy, not a footnote

- [TOOLS]

Why Claude Code’s prompt design beats IDE copilots

- [TOOLS]

Why Databricks Model Serving is the right default for production infe…

- [TOOLS]

Why IBM’s Bob is the right kind of AI coding assistant